扫码打开虎嗅APP

李开复说:人工智能的引爆点已经来到,VR 可以改变世界。

VR 改不改变世界先不管,但它已经可以“调教”人工智能了。

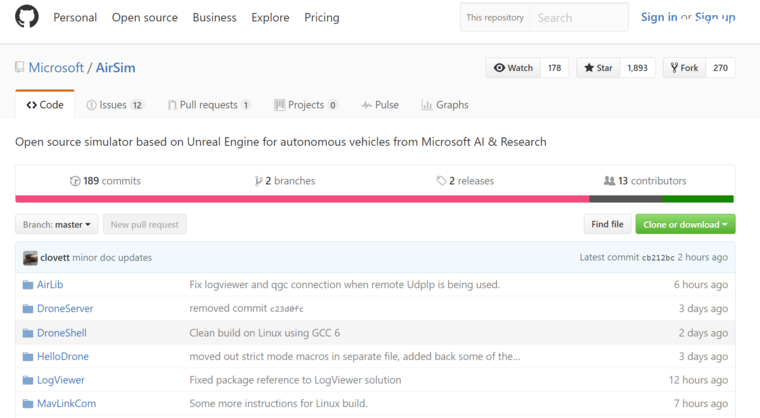

在世界上最大的技术宅集聚地 GitHub 上,微软开源了一个叫做 AirSim 的项目。这是一个高级虚拟现实训练系统——空中信息与机器人平台(Aerial Informatics and Robotics Platform),这个平台的主要目的是帮助开发者训练自己的人工智能适应各种现实环境中的场景。

可能很多小伙伴不太明白这个平台能够做什么。但如果你对人工智能有所研究,你就能明白这个项目对于人工智能的深度学习有着能够“弯道超车”的辅助作用。

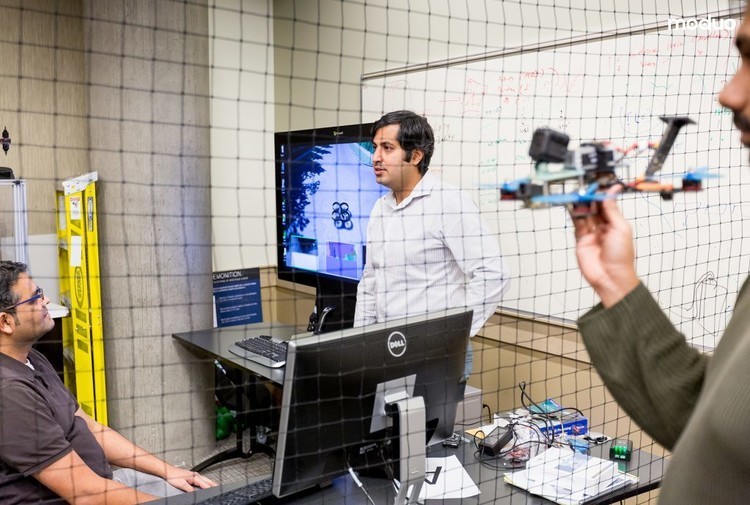

就拿无人机举例,一个无人机开发者要教会一个无人机能够自主躲避障碍物要在现实中进行成百上千次的测试来收集证据,再将这些数据进行分析,然后将数据编译成代码对无人机 AI 进行教学。

如果无人机在现实中训练,就会出现很多的问题。

如要调教无人机 AI 躲避墙壁就要考虑到墙壁的不同材质、墙壁在不同的光照情况下的反射、墙壁上的洞如何躲避等等。

同一物体的光影变化

这些问题是每一款无人机都要经过的测试,这些测试不仅枯燥而且要耗费大量的人力物力。最关键的是还不一定足够全面,而且还伴有一定的风险。比如无人机撞毁、误袭行人、失控。

感觉头有点凉

这个无人机是傻的

无人机袭人事件

那么,微软的工程师是如何解决这些问题的?

微软在 GitHub 上给出了答案——用 VR 去训练 AI!

在微软开发的这套训练平台上,开发人员可以:

通过很简单的方法模拟出无数种有细微差别的场景;

观察无人机 AI 在不同情况下的应对是否满足开发者的预期;

完全无视在现实中训练容易出现的问题,大大节省成本。

魔多君本着孜孜不倦的好奇心对微软在 GiuHub 上的日志进行了深层次的解析与研究。

这套训练模拟器用虚幻引擎的图形技术,弥补了以往模拟器所不具备的更多细节。如不同程度的炫光、雾霾、墙壁的阴影等等。

如上图所示,在整个监控页面有三个小的画中画。

左一用的是灰阶影像来显示距离的远近。颜色越接近白色表示物体距离机器就越近。

中间则用的彩色块来模拟每一个物体。一种物体就是一种颜色,能够完整的区分出无人机对于不同情况不同障碍的不同反应。便于数据的整理与收集。

右边就是无人机实时监控画面,能够清晰的反映出无人机的抖动、飞行情况等问题。

不光如此,主画面还能实时上帝视角观察无人机在空中的情况,直接解决无人机上天以后,观察员无法准确观察的问题。

三管齐下,一举N得。不得不佩服,微软这个技术有点牛。

这套系统给开发人员带来的好处也是巨大的。

1、开发者不用再担心无人机在现实环境中的损毁状况,也不用再担心无人机撞坏街道、建筑及行人,而被警察或者城管分批次敲门。

2、可以许多测试同时进行,收集的数据也就更多更快,也更能表现无人机的真实数据。

除了模拟器本身之外,空中信息与机器人平台还包括一个软件库,方便开发者通过简单的代码对接目前最流行的两个无人机平台 DJI 和 MavLink。

除了无人机这套系统还将引入到无人驾驶中,不过想想也是,毕竟无人驾驶AI技术在现实中但凡出点问题那就是大问题了啊。

比如特斯拉,无人驾驶技术吹上了天,然后撞了。

谷歌的无人驾驶汽车,不光撞了,还赔钱。

如果引用这套系统,那么这些问题就可以统统避免。

在虚拟现实中撞了,小事情,重新验证数据,再来就是了。省心!

负责这项研究的阿什什·卡浦尔(Ashish Kapoor)表示这个训练模拟器是 AI 研究的一次飞跃,在以往的 AI 学习中大多数的课题都会给定 AI 一个特定的规则,比如玩游戏或下棋。而这个模拟器让 AI 去“思考”在一个现实世界中该如何活动。微软此次将这个项目开源,是为了促进整个自动驾驶类人工智能领域的发展。

微软,干的漂亮。