扫码打开虎嗅APP

本文来自微信公众号:量子位(ID:QbitAI),作者:杨净、萧箫,题图来自:视觉中国

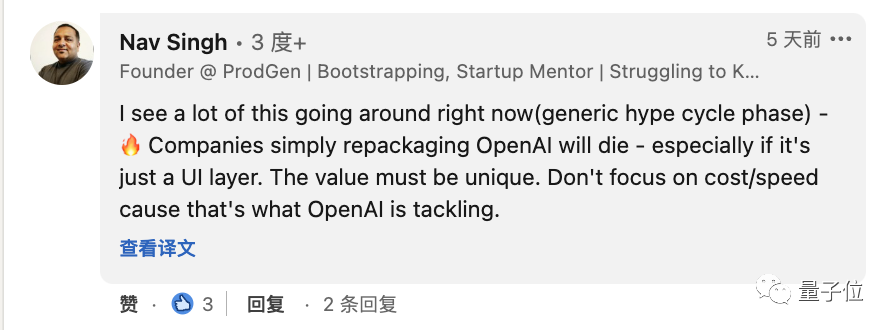

奥特曼简单一句话,让AI创业公司瑟瑟发抖:

“套壳”OpenAI,注定消亡!

这是在最新YC校友分享会上,OpenAI CEO奥特曼发表的演讲观点。为此他还特意补充道:尤其别花太多精力在UI界面上。

一时间引发共鸣无数。不少业内人士表示:

现实是,我就在目睹很多这样的事情发生。

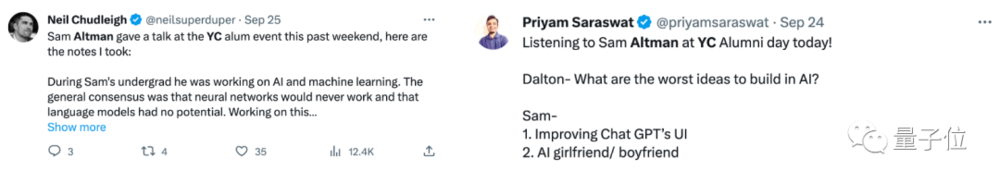

除了这句话以外,奥特曼这段演讲中可谓金句频出,个中不少“干货细节”,也被大伙儿纷纷摘录转发。

包括GPT-5、6的进展,关于AGI未来趋势的看法,以及亲身创业的种种。

比如,“AI女友”只是个美丽的陷阱,千万不要轻易尝试。

特意取个ChatGPT这样很像机器的名字,人类就不会对它产生感情。

听完演讲后的网友,甚至将之形容为“金子一般的收获”。

所以奥特曼究竟在这场演讲中分享了啥?一起来看看。

“简单学我者死”

在YC Alumni Reunion 2023上,奥特曼是有一些创业建议在身上的。在一些热心网友的总结中,大致可以分为三点:

简单包装OpenAI的公司活不长久。

看好AI医学顾问、AI个性化一对一辅导等方向。

盲目筹资是非常不明智的。

第一点对于简单包装,奥特曼举例比如有公司正在解决GPT模型的小缺陷,尤其只在界面上做文章的。

一来,OpenAI已经在解决大部分工作了;二来,这些仅在成本和速度上与OpenAI一较高下的公司,竞争优势并不会长久且持续。企业必须在提供真正独特的价值。

有网友联想到,前段时间红杉资本提出生成式AI进入到第二阶段——炒作和快速展示正在被真正有价值和完整的产品体验所取代。

种种观点,其实不谋而合。

不少业内人士都表示了肯定:

不要把自己放在菜板上,被OpenAI的下一个版本杀死。

(嗯,有官方逼死同人内味了)

但也有人提出了不同的观点:这种说法已经太多了,对我来说似乎很愚蠢。它透露了几点信息:垄断是好事;先发优势将会获胜……但竞争会促进进步,ChatGPT也确实有很多缺点可以改进。

既然如此,那有哪些方向是值得一做的呢?

第二点,奥特曼看好AI在医学、教育上的赋能——AI医学顾问以及AI个性化一对一辅导。这两者社会价值都十分巨大。

比如在教育场景,OpenAI自己也十分积极。

消息称,OpenAI正在筹建OpenAI学院,预计2023年底启动。它有可能是人人可访问的免费在线教学系统,老师能与GPT-5来互动,在课程期间接收反馈和指导。

在此之前,OpenAI也在GPT-4客户案例中展现了两个教育场景。GPT-4化身AI学习助手,既可以作为学生的虚拟导师,又可以作为教师的课件助手。

第三点,没有计划的盲目筹资非常不明智。别以为有钱了就万事大吉。

总结的网友还顺带说了句:奥特曼能做,不代表你也能做。

GPT-5究竟长啥样?

另一个热度极高的话题,就是OpenAI的下一代大模型——GPT-5和GPT-6。

对此,奥特曼在演讲中也剧透了下一代大模型的长相,但不多:

GPT-5和GPT-6将具备多模态输出能力,相比现有的GPT可靠性更高、个性化定制体验更好。

具体的多模态能力,有网友预测是能更好地完成像grounding这种NLP和视觉场景对齐的任务,如图像标注、视觉问答等。

结合此前奥特曼还暗示过GPT-5会具备语音识别、合成和情绪检测等新功能来看,GPT-5应该会具备“图文听说”等各种模态对齐的能力。

借着GPT-5和GPT-6的话题,奥特曼还给大模型“布了个道”:

现在,大模型领域的“摩尔定律”(Scaling Laws)已经开始发挥作用。大模型训练成本正变得更低、调用GPT接口的价格将变得更便宜。

Scaling Laws是OpenAI在2020年提出的一条定律,简单来说就是随着模型大小、数据集大小和用于训练的计算浮点数的增加,模型的性能会提高。

奥特曼认为,随着未来能源和计算成本快速下降,更强大的AI能力将会出现,“此前不敢想象的很多东西会被做出来”。

但即便大模型前景如此光明,奥特曼表示“距离AGI之路都还有很远”——无论是GPT-5还是GPT-6,都还远远不及AGI。

甚至光是“像人”这一标准,现阶段就还没AI Chatbot能做到:

即使背后用上了最前沿的AI技术,也没让我感觉到在和一个“人”聊天。

奥特曼认为,真正的AGI将能够掌握“自行推理”,即随着时间推移发展出新知识。像是能够根据物理学已有知识,写论文、做实验的AI,才能够得上AGI的门槛。

不过无论如何,都应该谨慎对待AI的输出结果:

人们会原谅人犯错误,但不会原谅计算机,二者的标准是不一样的。

对于AGI时刻的来临,奥特曼也给出了一个想象:

到那个时候,人们可能会经历一定程度的自我认同危机,但不会太糟糕和混乱。我们经历过很多次这样的时刻,技术终将变得无处不在。

“一个本科生坚持的结果”

最后,关于ChatGPT本身,奥特曼还cue到了两个小小的“花絮”。

其一,ChatGPT之所以叫ChatGPT,没有像人名的昵称,就是因为奥特曼不想往“AI女友”产品的方向上走。

其二,ChatGPT并非OpenAI最初就“倾力投入”的一个项目。

由始至终,OpenAI甚至只有一个本科生坚持做大模型方向的研究,其他人或多或少都转向过机器人、或是游戏AI等其他领域“发发论文”。

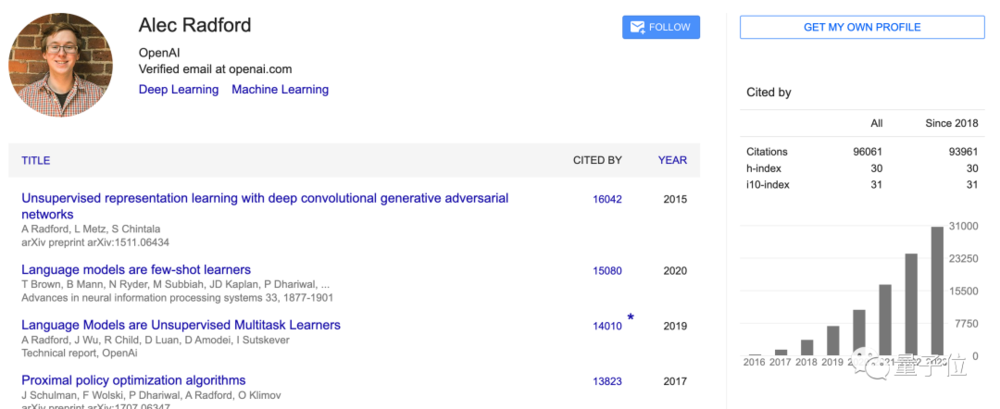

这个只搞大模型的本科生,就是Alec Radford,如今在谷歌学术上的论文引用次数已经达到9.6w+。

2016年,Alec Radford于富兰克林·欧林工程学院(Franklin W. Olin College of Engineering)取得学士学位,随后加入OpenAI,一干就是7年。

正是他所坚持的大语言模型路线,改变了OpenAI公司、乃至整个AI领域的发展方向。

对此,奥特曼半调侃半认真地表示:

招聘时,记得关注那些“看起来不会加入公司”的人。

OpenAI一开始并未确定大模型这一研究方向,但我们仍然招了AI研究员,并在取得突破后让更多人加入其中,最终成就了ChatGPT。

结合OpenAI招聘人才“不限行业”的规定,打破惯例看来已经成为这家公司获得灵感和活力的新动力了。

参考链接:

[1]https://twitter.com/sama/status/1705751665293554120

[2]https://www.linkedin.com/posts/ibamasood_chatgpt-can-now-hear-see-and-speak-nervous-activity-7112087060068368384-0OXb/

本文来自微信公众号:量子位(ID:QbitAI),作者:杨净、萧箫