扫码打开虎嗅APP

本文来自公众号:新智元(ID:AI_era),作者:新智元,原文标题《爱因斯坦70年前就预言了新冠爆发?这段AI复活视频火爆Reddit》,题图来自:视觉中国

4月8日,一段尘封多年的爱因斯坦视频登上了Reddit热搜,视频中爱因斯坦操着德国口音的英语,号召大家团结起来,一定能够战胜新冠病毒。当然,这并不是真的,视频出自一位名叫Chris的视频特效师,他使用了流行的DeepFake技术并结合自己精湛的后期技巧,制作了这段几乎以假乱真的视频。

没想到,爱因斯坦早就预知了2019年的新冠肺炎,而且还在1950年录下一段视频,鼓励大家团结一致共同抗疫。

这段只有57秒的视频中,爱因斯坦用他带着德国口音的英语说了这么一段话:

女士们,先生们我的名字叫Albert Einstein。

我们全体人类正陷入一场战争,

而我们的敌人却看不见摸不着。

请大家待在家里,保持距离,勤洗手。

团结起来,我们一定能够战胜新冠病毒。

谢谢。

刚刚看到这个视频的时候(高能预警),新智元小编震惊的手里咖啡杯掉在了电脑上(群众喜闻乐见的情景出现)。这是真的吗?看起来毫无违和感。

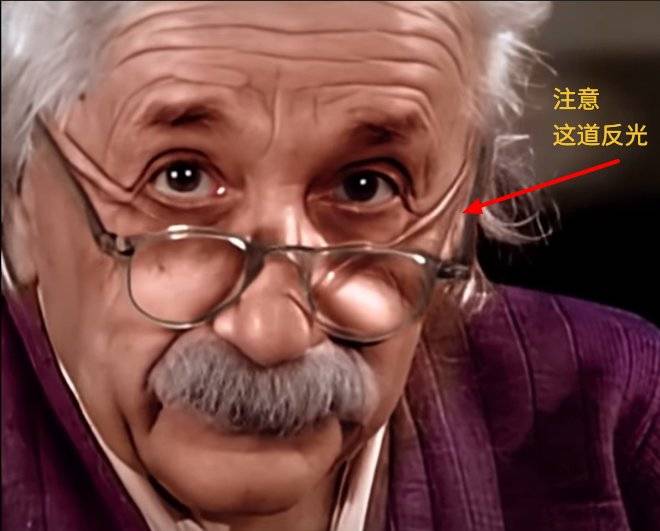

爱因斯坦那看透人类本质的狡黠的微笑、标志性的发型和帅气的胡渣子,甚至连额头的皱纹、眼镜片的反光都非常细腻,说话的语气和口音也非常逼真。

因为这是一段来自1950年的录像,镜头比例是4:3,也可以看到镜头中还会有一些胶片视频特有的瑕疵出现。

AI“秽土转生”:从未见过如此鲜活、精彩的爱因斯坦影像

实际上,这显然是一段人造的视频,靠的是AI(Artificial Intelligence)和AE(Adobe After Effects)。

视频作者Chris是一位视频特效师。

这个视频主要使用了DeepFake技术,配合作者高超的视频特效手法,制作出一个以假乱真的爱因斯坦视频。

使用AI让已故名人“起死回生”已经不是一件新鲜事了,但“从没人见过如此鲜活多彩的爱因斯坦影像”,Chris说。

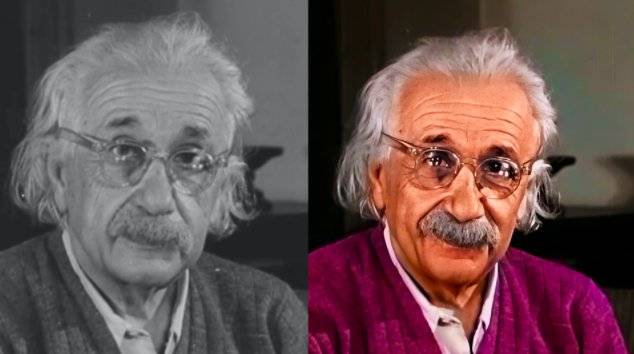

由于没有合适的视频素材,他自掏腰包买了一些商用的爱因斯坦视频素材,并提供了一张制作前后的对比图。来我们玩一把“大家来找茬”游戏:

他告诉新智元,这个视频的制作过程主要用到了以下方法:

视频恢复(摆脱抖动和胶片伪影)

超级扩展(将标清画质升级到高清画质)

锐化和添加细节,重新创建丢失的细节。

黑白转彩色

使用DeepFake来对口型

23fps转换成48fps

这个不到一分钟的视频,花了Chris差不多一周时间制作。当被问到做到如此逼真的效果,是不是有什么独门秘籍还是纯靠氪金的时候,Chris说都没有,可能唯一的秘籍就是:耐心和恒心。

醍醐灌顶的一句话,这不就是铁杵磨成针的故事吗!

作者告诉新智元,之所以使用爱因斯坦是因为他就是智慧本智,而且他的脸无人不知无人不晓。

如果爱因斯坦“站出来”呼吁大家采取一些行动(例如勤洗手,少出门),或许大家更能接受。

我们应该担心DeepFake吗?

去年,一个题为“突破:雪诺终于为第八季道歉”的视频在YouTube上大火,它以《权力的游戏》第八季中一个阴森的场景开场。雪诺,剧中的一个角色,正在发表演讲悼念一场重大战役中的阵亡将士。但是他没有谈到士兵们的牺牲,而是话锋一转开始向大家道歉。

他环顾四周的人群说:“是时候道歉了,很抱歉浪费了你的时间。对不起,我们没有从《迷失》的结局中学到任何东西。”

“我很抱歉,我们只用了六天时间写了第八季的剧本。”琼恩 · 雪诺说,“现在,让我们烧掉第八季的剧本,永远忘记它吧。”

接着我们就看到第八季的剧本在大火中被烧掉了。

这段视频到现在已经超过200万人观看,超过2000人评论。这段视频之所以引起如此大的轰动,还有另一个原因,那就是它的特技效果。琼恩 · 雪诺的道歉显然是假的,但它看起来和听起来都是真的。这一切都要归功于DeepFake。

DeepFake来源于一个匿名的 Reddit 用户“DeepFake” ,他从2017年开始发布假的名人色情图片。

在纽约州立大学奥本尼分校教授数字媒体取证的专家 Siwei Lyu 说:“这个用户在 Reddit 上开发的DeepFake算法是非常健壮和可靠的,操作起来也十分简便。”

随后,这个用户在GitHub开源了他的代码,其他开发者也实现了一些类似的算法并不断改进, 每个能联网的人,有点计算机编程和机器学习基础就能运行DeepFake,开始制作假视频。

当然这也引发了很多担忧,尤其是政客和明星在网上有很多公开的视频和图片,容易被不法分子或者别有用心的人利用,很多国家也开始考虑制定相关政策,禁止发布DeepFake制作的内容。

如何用DeepFake制作一个视频

首先,去GitHub上下载 Deepfacelab 或 Faceswap 软件。

接下来,要收集需要伪装的人的高清照片或视频,最好是视频因为可以采集到更多的角度和面部表情。

然后,把这些图片或视频信息输入给Deepfacelab,给它一两个星期的时间来“了解”这个人的面部表情和言谈举止是如何变化的,学习完了就可以按照自己的剧情生成假视频了。

最后要选一个外貌相似者的视频作为基础,然后把Deepfacelab学到的模型迁移到基础视频中,你可以简单地把某人的脸换成别人的脸,或者改变视频中人物说的话,并调整他们的嘴型使之匹配,就能生成以假乱真的视频了。

大部分DeepFake的研究都是基于生成对抗网络的,一个生成器,一个检测器,生成器生成假内容,然后询问对应的检测器内容是否是真实的,二者不断的互动来提高生成的内容质量。

DeepFake在特效行业释放了巨大的生产力,特效工作者不用再一帧一帧的修改视频,调整好参数,输入文件,后面的工作都有机器学习来完成。

如果世界上所有的东西都可以伪造,必然会引发大混乱,人们不会再相信看到的,听到的任何信息。也有乐观者认为,这就像是一场猫捉老鼠的游戏,双方的竞争会导致不断的技术进步。凡事都有两面性,乐观点看,DeepFake制作的娱乐视频带给人们欢乐,但同时我们也必须提高警惕,防止DeepFake给普通人或者公众人物造成不良影响,破坏我们正常的生活秩序。

本文来自公众号:新智元(ID:AI_era),作者:新智元