#AI有多智能

2020-05-14 12:20

扫码打开虎嗅APP

最近,一条 AI 修复的百年前老北京影像刷了屏。

过去老影像,或者说老电影的修复大多由人工完成,随着计算机视觉技术的发展,用 AI 修复早已不是新鲜事。

一般来说 AI 修复老电影分三步:插帧、提升分辨率、上色。

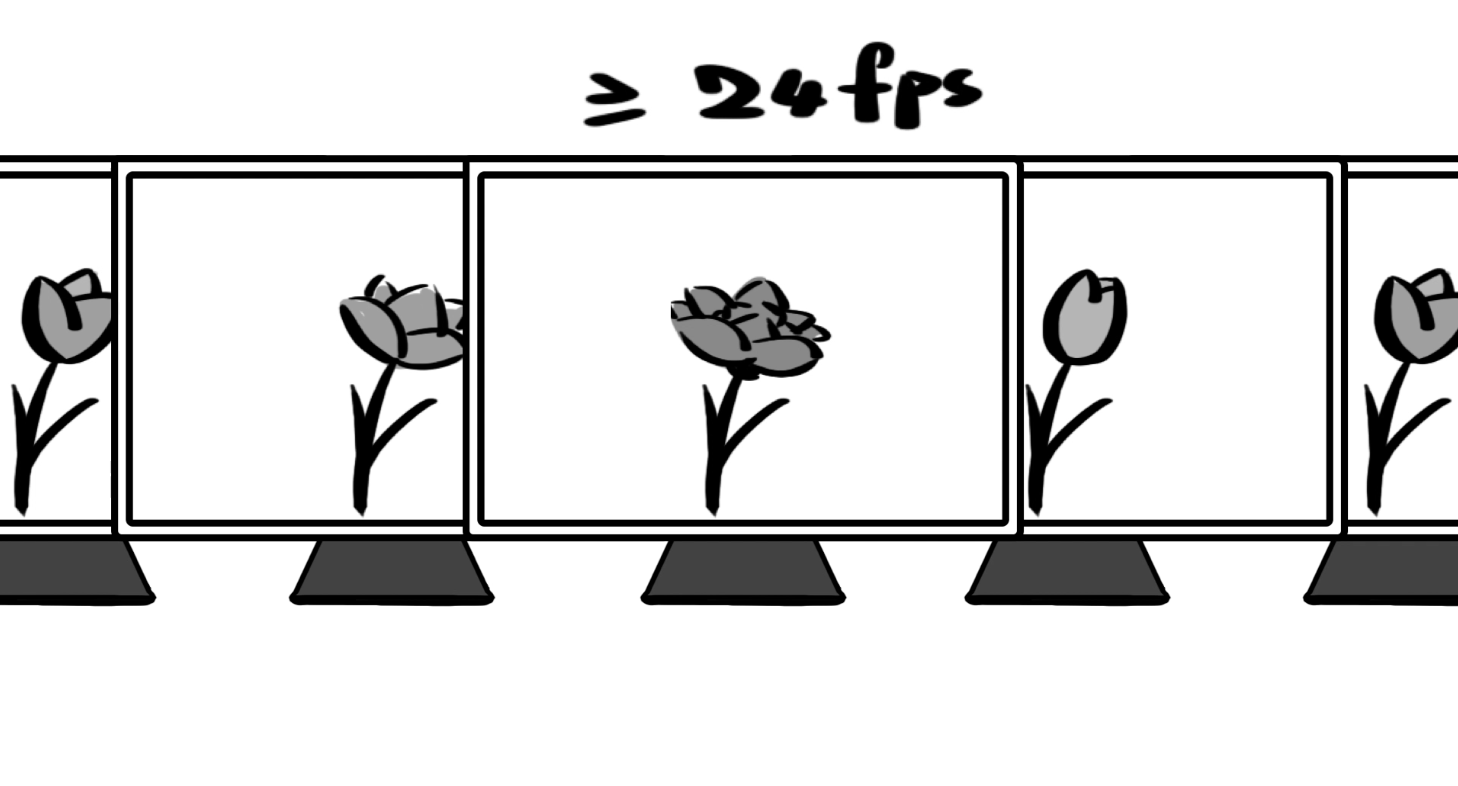

视频也好电影也罢,动起来的影像都是由一张张连续的图片组成的。每秒 24 帧是人眼感到画面流畅的下限,帧数越高、视觉效果越好。早期默片多在每秒 16 帧左右,想要适应现代人的眼睛,必须在其中插入「新的帧」。

人们大多采用分析前后帧画面,计算出中间帧的方法来插帧,这被称为光流法。有些手机、电视为了获得更好的视觉体验会主动插帧,部分播放器插件也能完成类似工作。

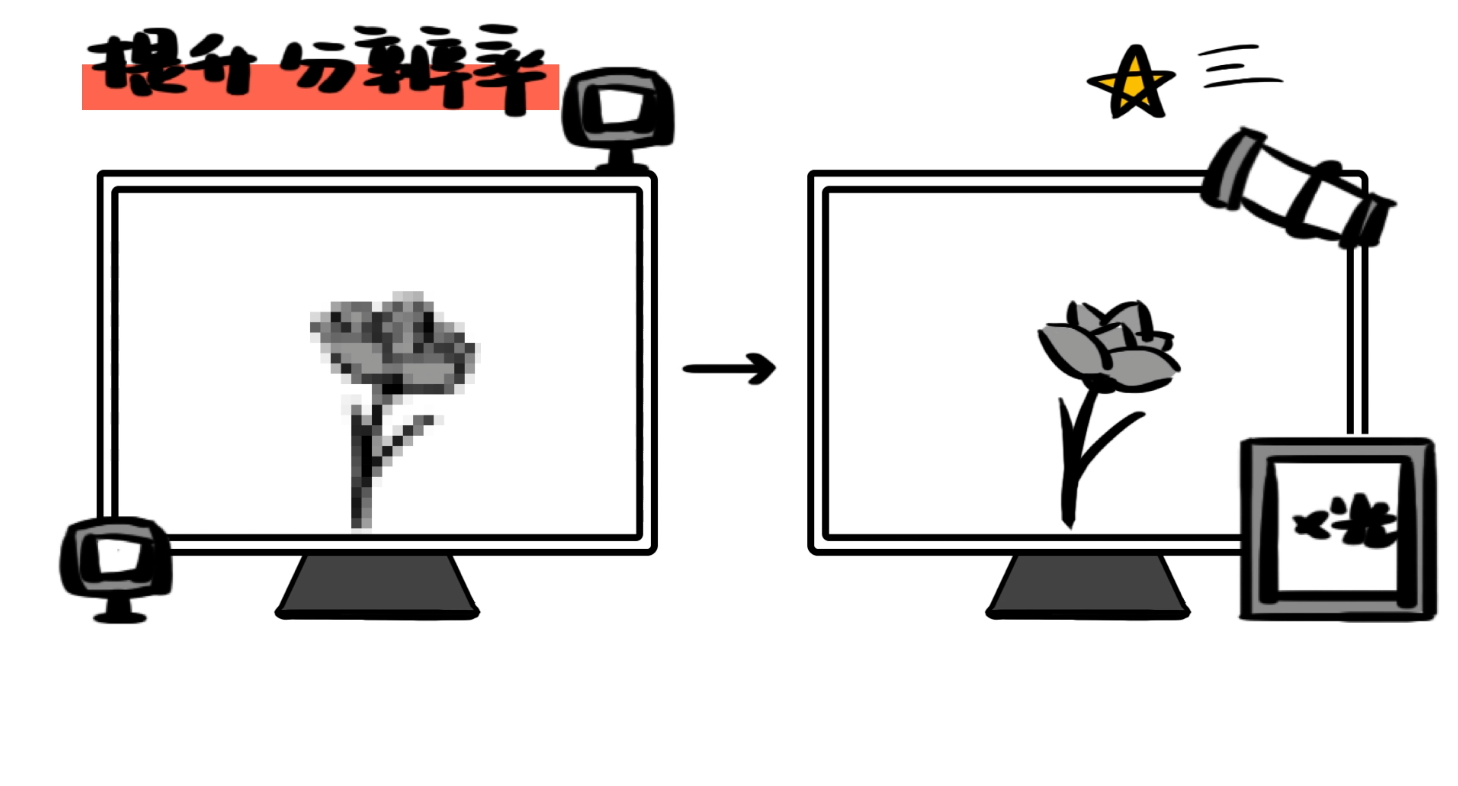

提升分辨率使用到的是超分辨率(Super-Resolution,SR)技术,即通过观测低分辨率图像重建出对应的高分辨率图像,在安防监控、卫星图像、医学影像等领域都有广泛应用。

目前主流的深度学习方法,是通过学习低分辨率图像与高分辨率图像之间的对应关系,对新的低分辨率图像进行重建。

上色的第一步是图像分割,即将图片中的不同内容物进行区隔。最好还能认出它们是什么,这样上色时才不会出错。再找到黑白图像中灰度与色彩的对应联系就能着色。老照片上色已有很多应用,视频上色最经典的模型是基于 GAN 的 DeOldify,多次迭代效果好,谁用谁知道。

这些技术中最早的甚至诞生于上世纪 60 年代。一份开源地址及应用列表,感兴趣可以试试看。