扫码打开虎嗅APP

本文来自微信公众号:机器之心(ID:almosthuman2014),作者:蛋酱、张倩,题图来自:视觉中国

特斯拉的 Autopilot 系统有多好骗?人类永远不会认为,树上的投影和户外广告中的标志是真实的,可惜特斯拉没这么聪明。

片头先播放一段广告(没收钱):

这段广告来自麦当劳,但有人在上面“动了手脚”:除了汉堡和薯条,还有一个“STOP”交通标志一闪而过。

虽然这个标志只出现了 0.5 秒,但却足以误导一辆特斯拉最新的自动辅助驾驶系统,使其下达停车命令:

路边的电子广告牌正在播放上述广告,一辆特斯拉从旁边经过时受到了广告中一闪而过的停车标志误导,将车停下

这种针对自动驾驶汽车的对抗攻击也不是什么新鲜事,但在以往的研究中,人们大多关注“有哪些东西是自动驾驶系统看不到的”。而这项实验的不同之处在于,研究者关注的是“有哪些东西是人类驾驶员不会留意,但自动驾驶系统会注意的”,比如上文中一闪而过的停车标志。

以色列本·古里安大学的研究者已经花了两年的时间来研究这个问题。此前,他们曾透露,特斯拉的辅助驾驶系统会被路上一闪而过的投影所误导,将这些投影看成路标或斑马线,从而在毫无预警的情况下将车停下。

在今年初的一项实验中,研究人员分别在道路、树木等物体上投射了人影、路标、道路标志线等误导性投影,结果搭载 HW2.5 Autopilot 的 Tesla Model X 全部中招。

特斯拉 Autopilot 将投影在路上的虚拟人当成真人,下达刹车命令

特斯拉 Autopilot 眼中的虚拟人投影

特斯拉 Autopilot 在地面标志线投影的误导下突然变道

在上述研究的基础上,研究人员继续改进实验。一项新的研究发现,在一个电子广告牌中嵌入几帧的路标也能达到相同的效果。

他们提醒说,如果黑客入侵了联网的广告牌,他们就能利用这一漏洞制造交通拥堵或事故,而且几乎不留下证据。这篇论文已被 2020 年第 27 届 ACM 计算机和通信安全(CCS)会议收录。

论文地址:https://www.nassiben.com/phantoms

研究人员发现,一张只出现 0.42 秒的图像就能成功欺骗特斯拉,而一个只出现了八分之一秒的标志骗过了以色列高级驾驶辅助系统——Mobileye。

将一个限速标志嵌入上述广告,时长为 125ms

向一个安装了 Mobileye 设备的汽车展示潜入了限速标志的广告牌,汽车被成功欺骗

为什么自动驾驶总是很好骗?

当然,本·古里安大学的研究者,不是第一批向特斯拉自动辅助驾驶系统发起挑战的人。早在 2016 年,南卡罗来纳大学和浙江大学等机构的研究者就曾经利用无线电、发光设备等成功地“愚弄”了特斯拉的自动辅助驾驶系统。

近日,还有一个中国团队发现,针对特斯拉的车道跟踪技术,只需要在道路上贴上贴纸,就能诱导特斯拉改变车道。

本·古里安大学研究者在这项研究中采用的是与二者不同的方法——至少不是物理方法。正如很多黑客此前所证明的一样,袭击者可以远程侵入联网的广告牌。团队推测这种“幻影攻击”会以勒索或者恶作剧等形式发生,论文第一作者 Ben Nassi 指出:“以前的方法会留下证据,需要复杂的准备工作。而这种方法完全可以远程进行,不需要任何专业知识。”

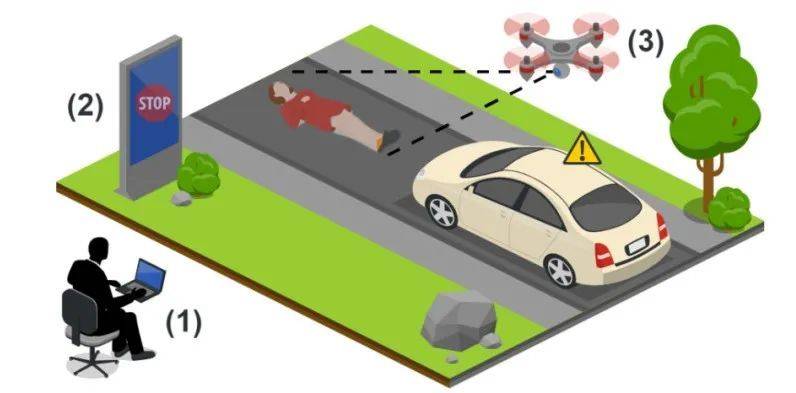

攻击模型

这种攻击有以下特点:

无需物理接近攻击现场;

不会留下任何可识别的物理证据;

攻击过程很短暂,几乎没有目击证人;

攻击的目标不太可能试图阻止攻击(通过控制车辆),因为他 / 她不会注意到任何异常情况。

面对这项研究结论,特斯拉尚未置评,但在上周的一封邮件中,特斯拉提到了一个熟悉的论点:它的 Autopilot 功能并不意味着是一个完全自动驾驶的系统。“Autopilot 提供了一种驾驶员辅助功能,仅适用于全神贯注的驾驶员,他们把手放在方向盘上,准备随时接管。”

但研究人员 Yisroel Mirsky 不赞同这一说法:“众所周知,人们在使用自动辅助驾驶系统时,不会始终保持100%的注意力。因此,无论特斯拉如何表示,我们都必须努力减少这种威胁,以确保人们的安全。”

特斯拉的 Autopilot 系统主要依靠相机,而不那么依靠雷达。而更加完备的自动驾驶汽车(比如 Waymo、Uber、Cruise)还集成了激光雷达,从而减少了受此类攻击的可能性,因为激光雷达不在乎广告牌上内容的变化。

对策:GhostBuster 系统

本·古里安大学的研究者并未测试针对更多传感器设置的攻击, 但他们演示了在基于摄像头的平台上检测到幻影的方法。研究者开发了一个名为 Ghostbusters 的系统,用于验证车载目标检测器检测到的物体,该系统的设计考虑了诸如深度、光线以及交通标志周围的环境感知等要素,并权衡所有这些要素,然后再确定道路标志图像是否真实。

打个比方,Ghostbusters 就像是一个专家委员会集思广益,来讨论出现的“影像”是真实存在的还是虚幻的,从而进行集体决策。在研究者看来,这种方法可以更加可靠地战胜“幻影攻击”,同时也不会降低基于摄像头的自动驾驶系统的速度。

GhostBuster 可以部署在现有的高级驾驶辅助系统上,无需额外的传感器,并且不需要对现有的道路基础设施进行任何更改。GhostBuster 由四个轻量级深度 CNN 组成,通过检查目标物体的反射光、环境、表面和深度来评估其真实性。在最终预测中,第五个模型使用四个模型的嵌入来识别“幻影”。

GhostBuster 架构图

实验表明,这一对策优于现有的基准方法。FPR 设置为 0 的条件下,AUC 超过 0.99,TPR 为 0.994。该模型应用于七种最新的路标检测器时,攻击成功率从未使用时的 99.7%~81.2% 降到了 0.01%。目前,研究者已经开放了训练后的模型、代码以及数据集。

项目地址:https://github.com/ymirsky/GhostBusters

本·古里安大学的 Nassi 承认,Ghostbuster 系统并不完美(GitHub 页面详细介绍了局限性),但他仍然认为即使特斯拉的自动辅助驾驶系统存在雷达、摄像头等多种传感器,黑客攻击生成的图像仍会让汽车出现判断问题。

作为车企,特斯拉自动辅助驾驶系统的原则是“better safe than sorry”,如果摄像头发现障碍系统就判定为障碍,反而会为黑客攻击提供机会。但如果不这么做,一个或几个传感器探测到了风险,其他却没有探测到不算数,可能会引发其他的麻烦。

“如果你的自动驾驶系统可以忽略图像攻击,又未能得到其他传感器的正确验证,就会有发生其他事故的风险。”Nassi 说道。“降低黑客攻击的风险需要付出代价。”

通用旗下自动驾驶公司 Cruise 的 Charlie Miller,曾在滴滴出行进行自动驾驶安全方面的工作,他对此反驳说:“基于激光雷达的自动驾驶实际上已经解决了这一问题。”

“对于系统传感器的工具总是吸引眼球的,但对于我所熟悉的系统来说,这并不是一种严重的攻击行为。”Miller 说道,“例如在 Uber 和 Cruise 的自动驾驶车队中。”

但他仍然认为 Ben Gurion 的研究很有意义。“这是我们需要考虑并着手应对的问题。对于特斯拉来说,其辅助驾驶系统依赖于视频输入内容,这种系统必须保证可被信赖。”

参考链接:https://arstechnica.com/cars/2020/01/how-a-300-projector-can-fool-teslas-autopilot/

本文来自微信公众号:机器之心(ID:almosthuman2014),作者:蛋酱、张倩