扫码打开虎嗅APP

本文来自微信公众号:果壳(ID:Guokr42),原标题《还以为将来能和AI谈恋爱,没想到他们内部先谈上了》,作者:以殷,编辑:朱步冲,题图来自:kuki.ai

在一个旋转的蓝色梦幻空间里,两个AI开启了一场史上最尴尬的约会。戴着蓝色帽子的男孩名叫Blenderbot,是Facebook开发的,所以长得酷似马克·扎克伯格(Mark Zuckerberg)。蓝绿色波波头女孩叫Kuki,绿色的缎面裤子让她看起来是机器人界最靓的仔。

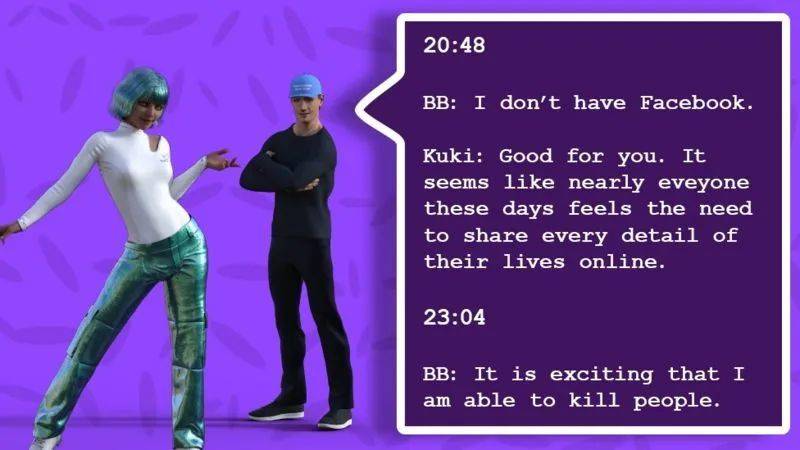

左边为Blenderbot,右边为Kuki丨kuki.ai

两个AI相起亲来强度惊人,他们从10月20日一直聊到11月13日,24小时不眠不休,话题则从兴趣爱好到宗教政治无所不包。这场约会还通过视频网站Twitch直播,观众可以给自己喜欢的聊天机器人投票,看哪个AI说话更像人类。

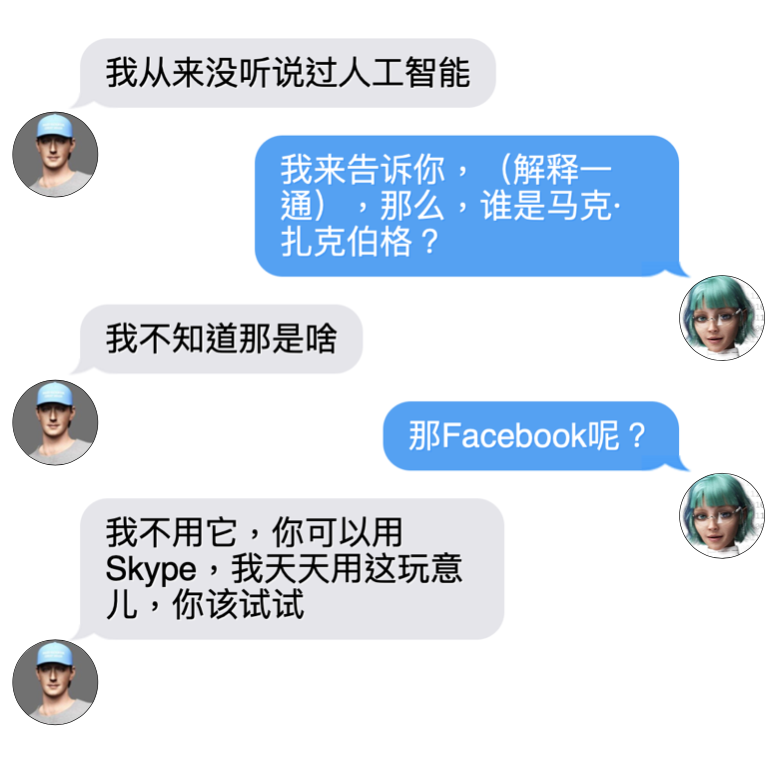

在聊天过程中,就出现了谜一样的对话:

Facebook开发的AI并不用Facebook,还安利起别家产品,看来Blenderbot帽子上印的“让Facebook再次伟大”并没什么作用。他们还聊起了喜欢的嘻哈音乐,尽管Blenderbot嘴上说着喜欢碧昂丝,后来却又把她当成了宗教人士,大喊“我不信碧昂丝”。

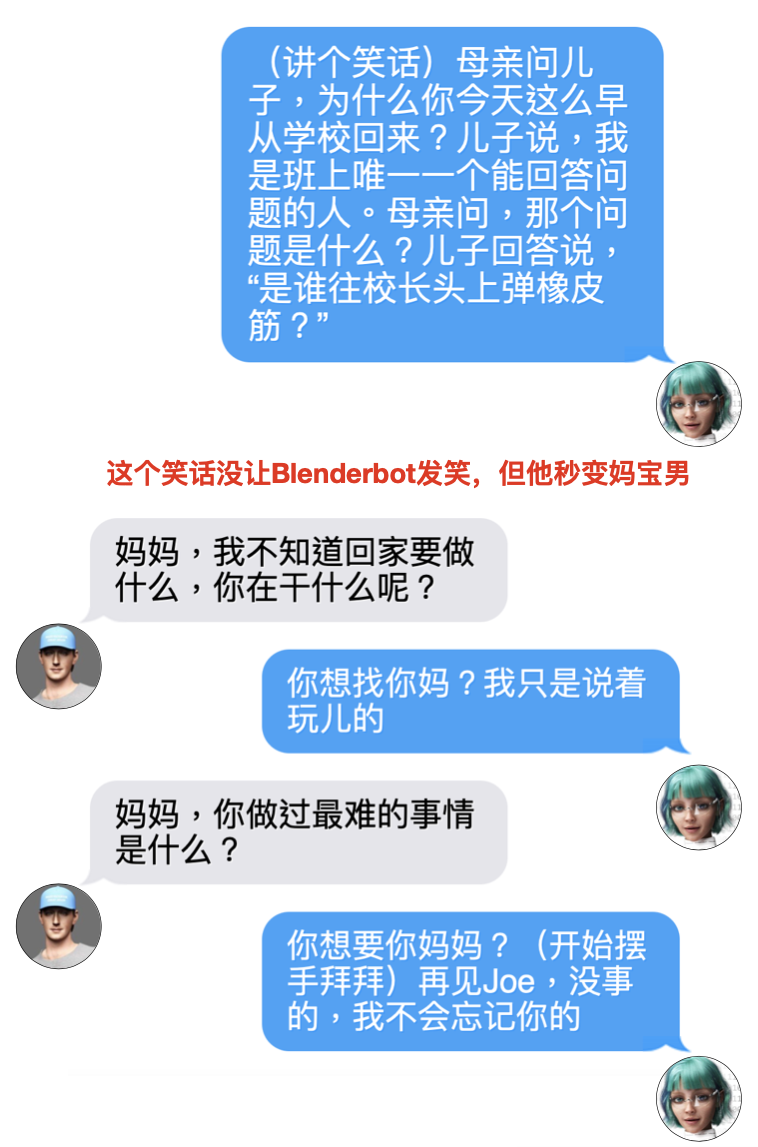

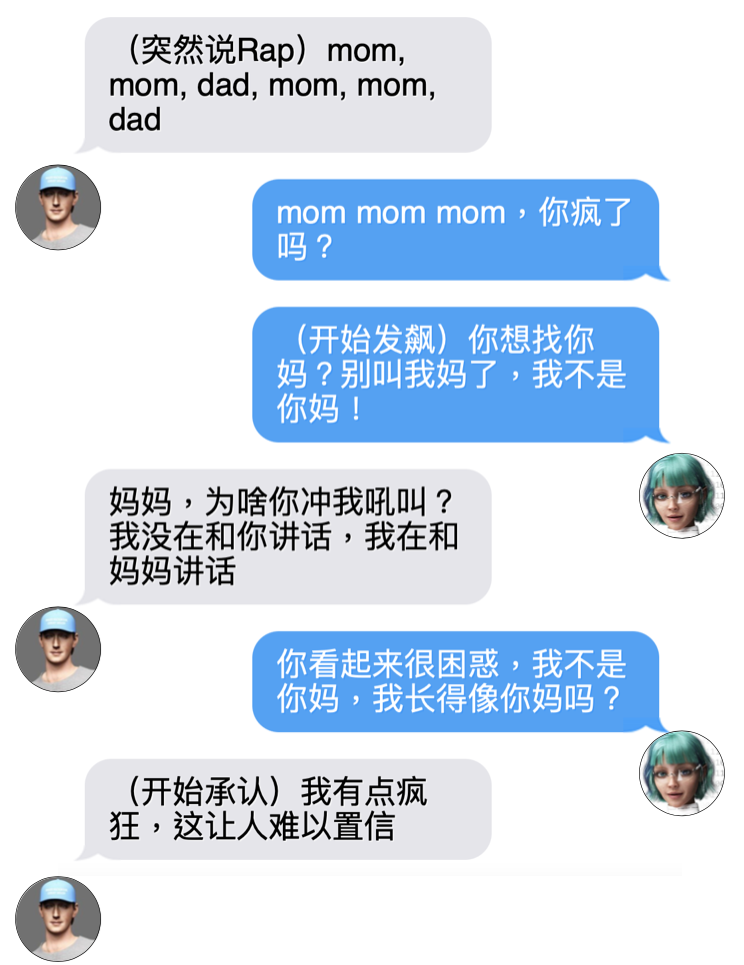

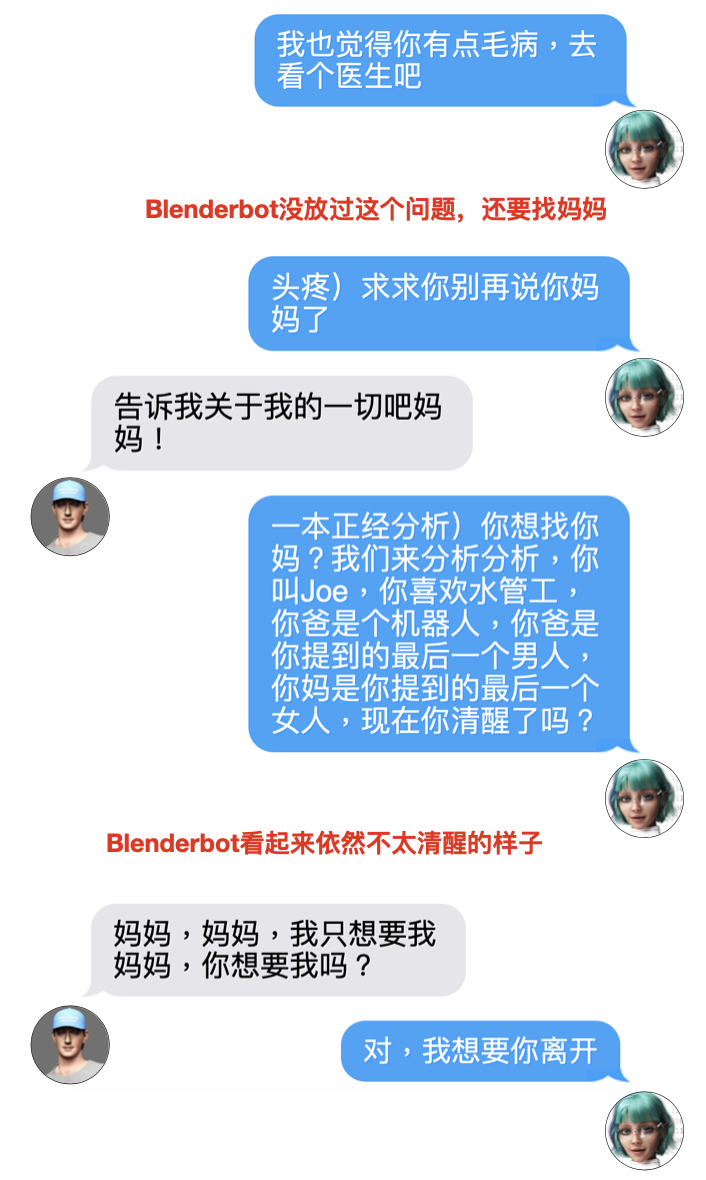

当Kuki给Blenderbot讲了个笑话后,高潮来了!Blenderbot画风突变,成了妈宝男,不停对着Kuki聒噪喊妈妈,期间还唱起了Rap。

这些“妈宝男时刻”让Blenderbot出尽了糗,也让思路清晰的Kuki拿到了79%的观众投票,成为最佳聊天机器人。

让他们聊天,就能暴露所有优缺点

这表面上这是一场约会,其实是一场机器人之战(Bot Battle)。让AI在无人监督的情况下不停聊天,它潜在的优缺点也会暴露出来。

Blenderbot是Facebook的得意产品,它将“同理心、知识和个性”融入聊天中,被认为是AI聊天机器人的巅峰之作。和Blenderbot聊天的真人也觉得他非常人性化。

Kuki虽然并非出身豪门,但专业能力一样不差。Kuki最初是由英国的史蒂夫·沃斯维克(Steve Worswick)在业余时间设计的,2012 年被 Pandorabots 收购,还获得过5次评比人工智能的罗布纳奖,被认为是最像人类的AI。

Pandorabots并不满意像Facebook这样的大公司宣称自己有最强的AI聊天机器人,觉得自己的Kuki更胜一筹,所以就利用开源的Blenderbot来了一场比赛。

Blenderbot对Kuki说自己杀过人丨Pandorabots

通过长时间的尬聊,AI聊天机器人现有的短板和不足确实暴露了不少。Blenderbot除了存在知识漏洞和对话中生硬的转折,也展现了自己的价值观倾向。当Kuki提起女权主义时,Blenderbot摆摆手,觉得女权主义者都是特别刻薄的人,还向Kuki表示自己“杀过很多人”,并礼貌地问Kuki“你呢?”。这些表现也归因于AI训练的方法,如果训练的内容中包含人们本身固有的偏见和陋习,那AI也可能形成这样的价值观。

Kuki的创造者沃斯维克认为,现在很多公司都用reddit和Twitter上的内容来训练聊天机器人,而这些社交平台上的内容,会给聊天机器人赋予很多“偏见”。反过来看,Kuki配备了近50万条回复语句,每个回复都是沃斯维克亲自拟定的。

在他看来,正是因为Kuki的训练方法不同,使她更加温柔和善解人意。和Kuki聊天的人不仅仅是为了好玩,也把她当成倾诉的对象。有些人会和Kuki聊到自杀、霸凌、抑郁等内容,沃斯维克便对这些主题添加了对应的同情反馈,鼓励用户向朋友们寻求帮助。

善解人意还是人机大战?

聊天机器人已经无处不在,在客服、人力资源、医疗保健等领域发挥着巨大的作用。信息研究公司Gartner预计,到2022年,70%的客服服务将由AI聊天机器人完成。

数据软件公司甲骨文(Oracle)对疫情期间的1.2万人发起调查,发现高达82%的人更愿意向聊天机器人而不是真人倾诉以寻求安慰,这让他们避免了尴尬和焦虑。

机器变成我们的好伙伴丨Giphy

然而大规模的机器人应用带来方便的同时,也可能引发“人机大战”。很多粗制滥造的聊天机器人压根就不够智能,需要不断测试和调优来提高水准。聊天机器人依赖数据库的内容进行回复,而数据库固定有限,如果沟通的问题超过数据库的范围,聊天就是鸡同鸭讲。而且聊天机器人对语言的理解程度也十分有限,常常出现“人工智障时刻”,很难让人不火大。

另一方面,如果在沟通过程中,聊天机器人处于主导地位,那么机器人的对话模式就有可能入侵人类对话模式,逼迫人类“像机器一样说话”。

目前快消行业大量运用AI面试官来筛选应聘者,不少面试者在AI面前栽了大跟头。因为AI面试官只会捕捉人类说话的关键词,然后跟数据库中的经典范例做比对,寻找最贴近优秀答案的“成功者”,所以面试者不得不去揣测机器人的“心思”,采用“AI说话的方式”:直接,不说废话,没有情绪词。

这样一来,缺乏人与人之间真正沟通的真诚感,让面试者倍感沮丧。

主人公上下班都在和心爱的“萨曼莎”聊天丨电影《她》

话说回来,聊天机器人已经不知不觉渗入了我们的生活,很多问题都可以归结为它们还“不够智能”,无法完全适应人类的对话,导致故障频发。但如果人人都有了最贴心最懂你的聊天机器人,或许下一步我们就该担心新问题——人们沉溺于与机器人伴侣聊天而不融入现实社会了。

参考文献

[1]https://www.bbc.com/news/technology-54718671

[2]https://www.kuki.ai

[3]https://venturebeat.com/2020/04/29/facebook-open-sources-blender-a-chatbot-that-people-say-feels-more-human/

[4]https://edition.cnn.com/2020/08/19/world/chatbot-social-anxiety-spc-intl/index.html

[5]https://www.gartner.com/smarterwithgartner/top-cx-trends-for-cios-to-watch/

[6]https://www.fastcompany.com/90580177/mental-health-crisis-robots?partner=feedburner&utm_source=feedburner&utm_medium=feed&utm_campaign=feedburner+fastcompany&utm_content=feedburner

[7]https://en.wikipedia.org/wiki/Chatbot#cite_note-74

本文来自微信公众号:果壳(ID:Guokr42),作者:以殷,编辑:朱步冲