扫码打开虎嗅APP

本文来自微信公众号:腾云(ID:tenyun700),作者:peter东,原文标题:《《自然》最新论文:转发假消息的人可能是“明知故犯”》,头图来自:视觉中国

对于虚假信息传播,有一个常见的误区是:人们之所以分享虚假信息,是由于人们误以为他们分享的信息是准确的。于是“无知者无畏”,假消息被一次次转发分享,进而危及整个社会。

这听起来是再正确不过的解释。但事实真的如此吗?

来自麻省理工大学媒体实验室、斯隆商学院和加拿大里贾纳大学在内的研究者在3月17日的《自然》杂志发表了题为 Shifting attention to accuracy can reduce misinformation online 的文章。对这一传统认知提出了挑战。

一、人们分享内容的首要动机是?

研究人员以上千名美国网民样本进行实验。

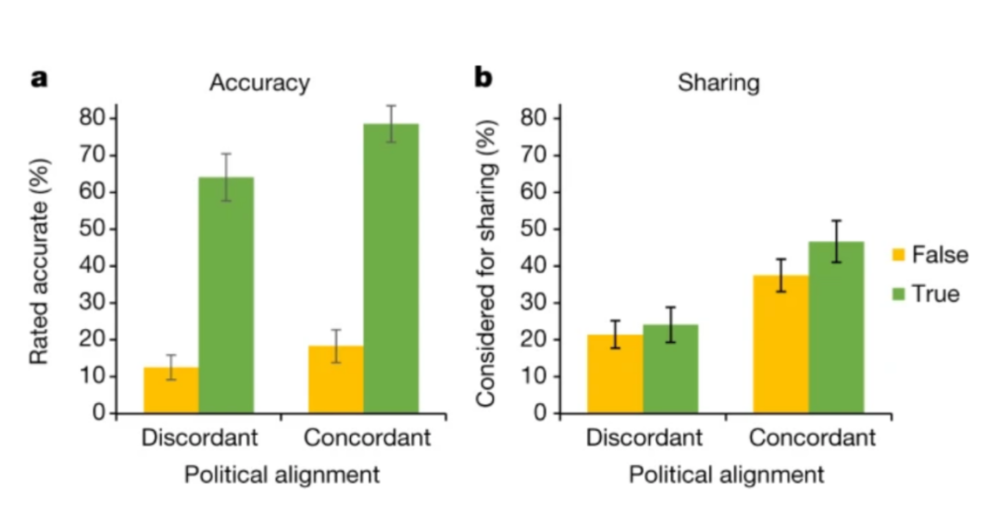

首先,他们在亚马逊机器人上招募了1015位受试者,向他们分别展示了36则来自社交媒体的真实新闻。为了保证平衡性,其中有一半的标题是虚假的,另一半的标题是准确的;一半偏向共和党,另一半偏向民主党。受试者被随机挑选,评价新闻的准确性,以及自己是否愿意分享这样的信息。

结果他们发现,不管是否倾向自己的党派,在被问及关于准确性的问题时,受试者都能很好的分辨标题真假。

但有趣的现象是,一旦人们处于分享状态时,这些标题是否符合受试者的政治立场,对他们是否分享消息的决定影响更大——远大于消息准确性的影响。

例如,面对与移民问题有关的明显的假新闻标题《500个移民篷车由于带着自杀夹克被捕》(Over 500 ‘Migrant Caravaners’ Arrested With Suicide Vests)时,研究者发现,虽然只有15.7%的共和党人认为这是准确的消息,但却有51.1%的共和党人表示他们会考虑分享这则消息。

简而言之,在分享按钮面前,即便人们知道消息可能存在虚假的可能,也更愿意分享与自己立场一致的消息,而非他们认为真实的消息。

所以,是不是说人们为了强化自己的立场、喜好,故意传播虚假消息?或者,是不是说相比于消息的真实准确性,人们更重视个人立场和喜好呢?

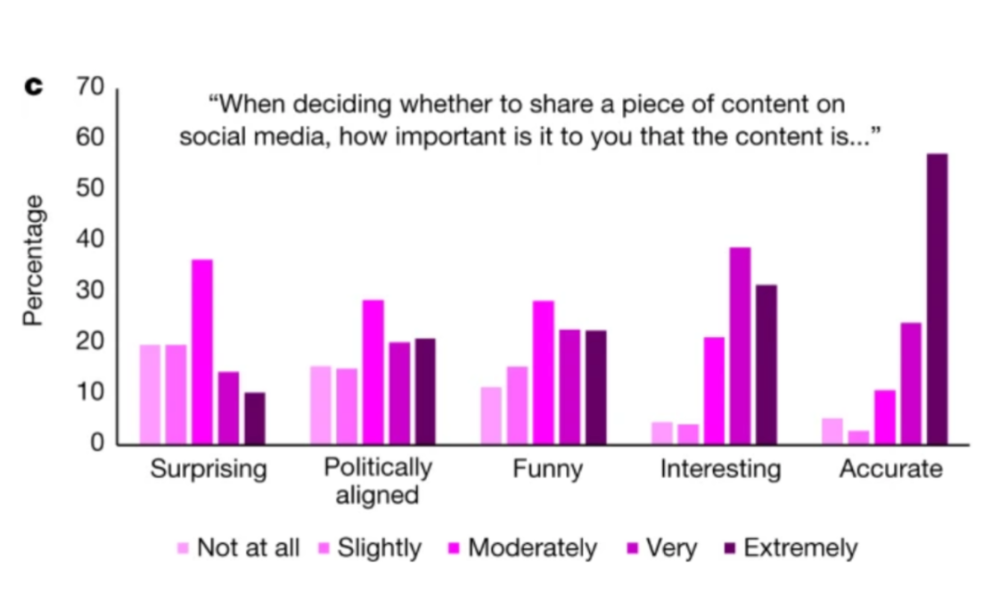

研究人员进行了第二轮调查。通过问卷,他们让受试者为消息的各种维度的因素的重要性评分,例如真实性、立场、喜好、令人惊讶的程度...

调查结果显示,此时,绝大部分受试者都认为,相比于立场、有趣、惊奇等因素,“消息的准确性”是才是更重要的。

看到这里,你可能也陷入了相同的困惑——两个调查结果互相矛盾吗?

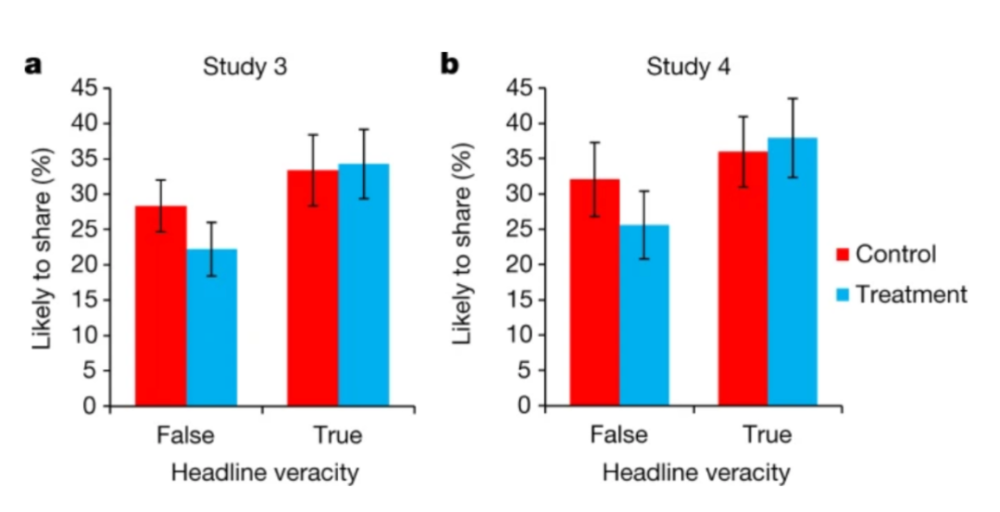

为了弄清楚这个问题,研究者开始了第三轮实验:在接下来的测试中,受试者在进行相关测试之前,被要求先对没有政治倾向的消息的准确性进行判断。

例如,在转发每一条消息之前,其中一组受试者会被要求先对该消息的准确性进行评分,与另一组没有增加准确性评分的对照组相比,这一组被试者分享假标题的可能性要小得多。

也就是说,当所谓准确性启动效应开启之后,大家转发虚假消息的频率大大减小了——尤其是对那些与个人三观一致的虚假消息,被转发的几率大大降低。这样的干预手段对那些看起来最不靠谱的新闻标题效果最明显。

对2016年美国大选中推特上的大规模研究也发现了相同的趋势——当询问有哪些因素会影响分享的意图时,人们普遍指出信息的准确性十分重要,但事实却与之背道而驰。

人们为什么会愿意分享自己明知不准确的信息?

由此可见,激励人们分享的动机不仅仅是传播准确的信息,还有塑造自身人设、吸引朋友或陌生人的关注,因此在分享时起到关键作用的指标,与冷静被调查时的选择会出现显著差异。

进而,研究人员认为,人们转发虚假消息的主要原因,并非没有能力对信息的准确性做出判断,而是没有足够的注意。

下图中,横轴代表新闻标题的准确性打分,纵轴代表干预对分享意图造成的影响。可以看出,准确性越差的新闻标题,如果在分享前对受试者进行提醒,分享意图的降幅越大。这进一步说明了人们会分享这些虚假信息不是由于人性的虚伪,而是由于注意力的有限。

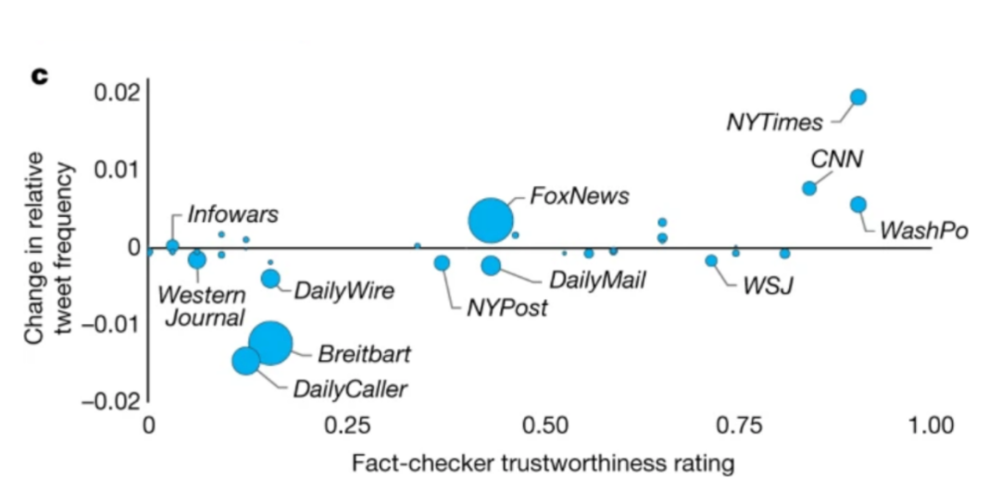

之后,研究者在推特上,针对5000名用户进行实验,要求他们在发送消息前,先判定消息的准确性,之后评价其在24小时内分享信息的模式和他们日常的模式有什么区别。结果表明,这些用户对主流媒体的转发频率上升,而转发来自虚假信息泛滥的社交媒体的信息的概率大大降低。

这是令人兴奋的结论。这为治理虚假信息、优化社交媒体产品设计等方方面面提供了重要参考。

二、问题背后的复杂性

在中国的互联网世界中,养生、健康类在虚假信息中尤为突出,老年人、三四线城市居民,普遍被认为更容易被相关谣言攻陷。即便是对于生活在大城市、每天接触大量信息的年轻中产阶级来说,也常常会在涉及公共议题的互联网讨论中,受情绪驱使,成为假消息的传播者。

无论是消除数字鸿沟,还是促进互联网世界的理性讨论,上述研究给我们的启发是,我们首先需要了解是什么因素决定了人们的分享行为。

虚假信息的提供者在操纵人类情感方面非常出色,但请注意,我们依然不能简单的认为基于美国人的调查就一定符合中国国情。即便社交媒体似乎打破了地域限制,但地域间差异依然存在。

例如,借用传染病学的模型,《自然人类行为》去年10月的一篇论文对信息流行病(infodemics)开展了研究,该研究对各地区社交网络用户的发布的新冠相关信息进行汇总、打分,给出代表该地区的信息流行病的严重程度的“信息流行病风险指数(Infodemic Risk Index )”。

该研究表明,在不同地域中,信息流行病的严重程度的变化是独立的,这和社会经济发展程度、单日新增病例没有相关性。这打破了人们的传统认知。

由此可见,与虚假信息作斗争需要一个全面的反应,这远远超出了计算机研究的范围,包括教育学、心理学、新闻学和社会学等诸多学科。也正因如此,此类研究应该被划入复杂性研究的范畴。

圣菲研究所应用复杂性研究员Garland就曾指出,首先我们应该把信息的传播环境看做一个“生态系统”,关注信息所具有的多维度(例如信息包含的情绪、信息准确性等多个评价标准),深入理解那些假消息的“需求方”(即潜在的受众),进而才能够更巧妙地遏制虚假信息,而不是束手无策。

其次,在假消息的“供给方面”,计算科学家应该和社会学家合作,理解信息传播的过程(例如超级传播者,越过临界点之后的病毒式传播)。同时,自动化的工具可以用来找到虚假信息传播过程中的关键个体。这样的算法可在虚假信息传播之前发现和隔离它们,或者至少减轻它们的影响。

具体来看,这类研究有六个目标:

一是大范围地检测虚假信息,例如识别Deep Fake合成的视频,找出机器人账户,算法生成的虚假信息等;

二是量化虚假信息的影响范围,包括长期的和次生伤害;

三是提供数据访问的“基础设施”,从而可以让更多的研究者,能够获得信息传播的数据;

四是探讨互联网背景下新的伦理规范,例如定义何为公共空间,隐私的范围多广;

五是找出合适的教育干预手段,提升大众对虚假信息的免疫力;

六是培养专业人士,让他们具有持续对抗虚假信息的技能和工具。

如果你正在关注该领域的研究,这或许会为你带来一些方向性的启发。

总之,信息的传播过程就像任何其他复杂系统一样,注定无法通过简单、单一的方式来进行,解决这个问题需要与系统进行互动,同时尊重对权利、伤害和正义的伦理关切。这需要专业人士,来平衡量化研究对海量数据的需求与保护用户隐私,避免伤害用户体验之间的权衡。

而要想真正了解不同文化背景下虚假信息传播的不同,需要构建多语言数据库,采用自然语音处理技术,来自动化地收集分析数据,而这也需要学术圈和产业界的通力合作。

本文来自微信公众号:腾云(ID:tenyun700),作者:peter东