扫码打开虎嗅APP

本文来自微信公众号: APPSO ,作者:发现明日产品的,原文标题:《99% 的大学生都在用 AI,科学家说他们是第一代比父母笨的人》

春节假期过去,单位开工,学校开学,学校老师又要开始头疼了:现在,几乎每个学生的手机里,都多了一个AI助手,能查资料、做作业,答疑解惑甚至比老师还厉害。

但是学生们并不一定越变越好。从19世纪开始,有记录以来,每一代人都比上一代更聪明,他们比自己的父母接受更好的教育,有更好的生活条件,也自然而然地比自己的父母更聪明——直到Z世代。

上个月,神经科学家Jared Cooney Horvath在美国参议院商业委员会的听证会说了一句让人坐不住的话:Z世代可能是有记录以来第一代比父母更笨的人。

这个趋势有个专门的名字,叫弗林效应(Flynn Effect):随着社会现代化,营养改善、教育普及、认知任务增加,人类的IQ分数一直在涨。

科学家们预测过这个趋势会放缓或者见顶,但没人预测过它会掉头向下,Z世代在几乎所有认知指标上都不如上一代——执行功能、读写能力、IQ、记忆力、注意力,全面退步。

这能把锅甩给AI吗?AI大规模进入日常生活也就是最近三四年的事啊。

不错,这场衰退从互联网时代就开始了,智能手机让它加速,而AI正在把这个问题推向一个全新的量级。

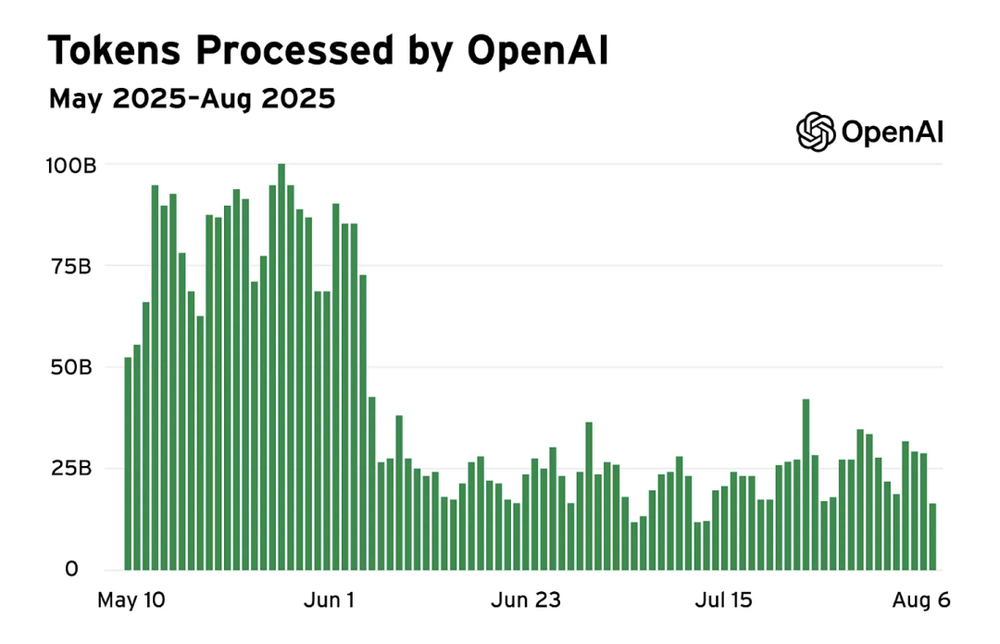

2025年的数据显示,超过90%的美国大学生在学业中使用AI,高中生的使用率也达到了84%。OpenAI自己的数据间接印证了这一点:去年暑假一开始,ChatGPT的对话量就断崖式下跌。

图片来自:OpenRouter

与此同时,AI公司正在主动向校园渗透。Anthropic花1750美元雇「校园代表」推广Claude,为期10周。OpenAI和Google在期末季向大学生免费开放Pro版本。

而学校几乎没有还手之力。各校花了大量经费采购AI检测软件,但研究表明市面上的检测工具基本不起作用。OpenAI曾在内部开发出一种针对自家模型的文本水印技术,通过调整模型预测下一个词的概率分布,植入人类不可察觉但机器可检测的统计模式。据《华尔街日报》2024年的报道,该技术内部评估有效性极高——但OpenAI最终以「可能影响用户体验」为由搁置了它。

连自己能做到的最低限度的透明,都选择了不做。

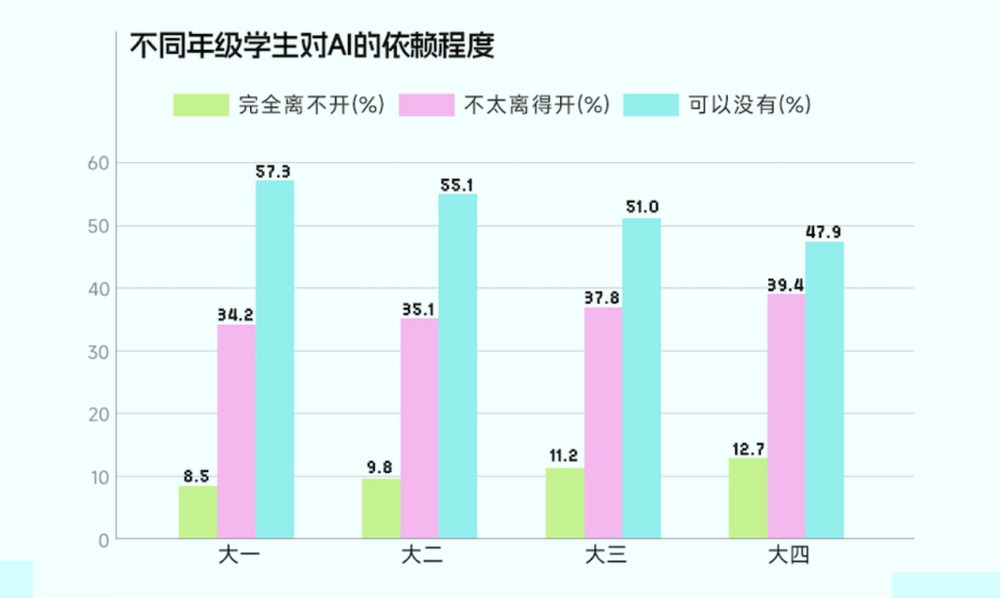

这不只是美国的问题。2025年,中国青年报联合Soul App对全国高校学生的调研显示,99.2%的受访大学生已在使用AI,65.9%遇到问题时下意识先找AI,47.1%坦言离不开AI。AI工具的渠道偏好评分(3.34/5)已经超过传统搜索引擎(2.60)和社交媒体(2.81),成为大学生获取信息的第一选择。

图片来自:中国青年报

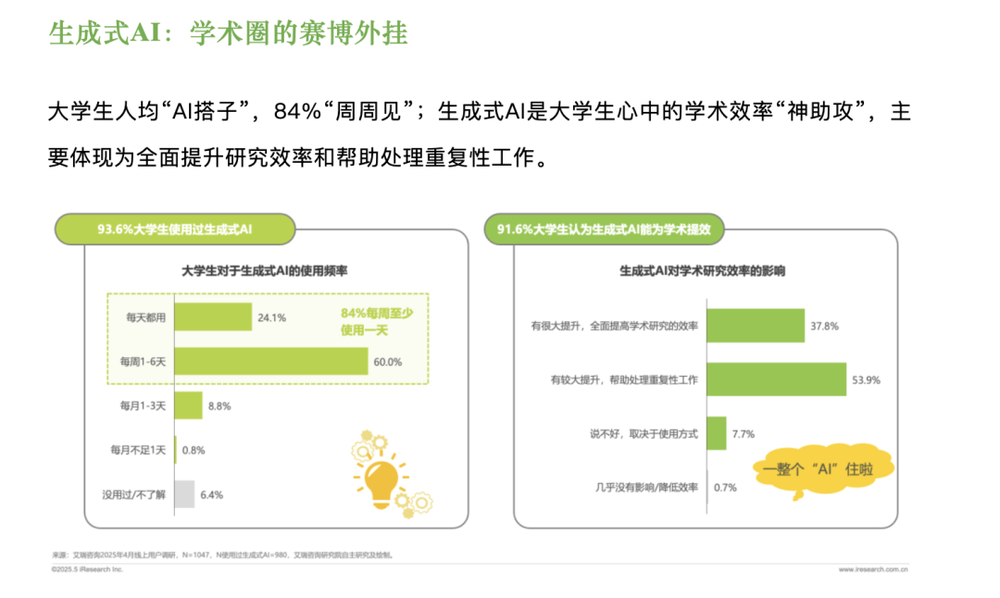

艾瑞咨询同年的调查则指向了一个更具体的场景:62.9%的大学生在写论文遇到困难时会直接向AI提问,超过半数在写论文时使用生成式AI。2025年起,部分高校已对毕业论文实行重复率+AIGC重复率双查重制度。

图片来自:艾瑞咨询

但最值得注意的是清华大学的一项研究,它几乎完美地印证了前文的论点:使用AI学伴的学生在初期课后测试中表现优于未使用者,但两到三周后,这一优势发生了逆转——AI使用者的得分反而落后于对照组。

图片来自:中教全媒体

短期提分,长期退化,这不就是妥妥的认知债务吗?

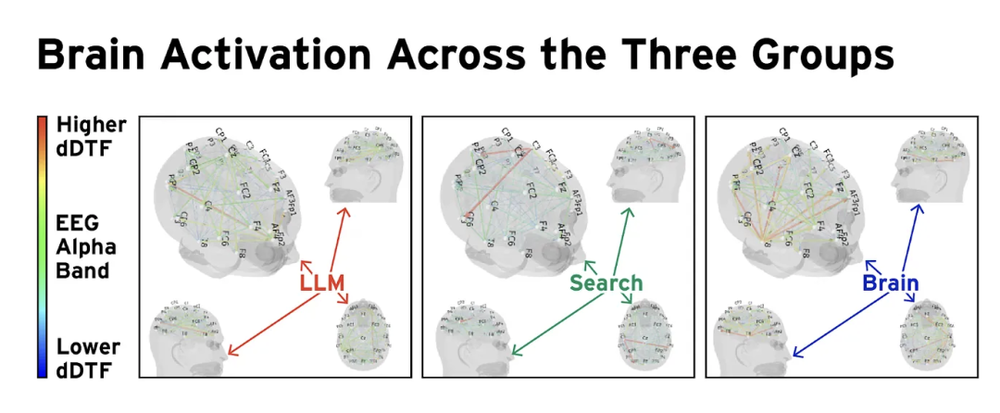

一项发表在arXiv上的研究(Your Brain on ChatGPT:Accumulation of Cognitive Debt)做过一个直接的实验:让学生分别用搜索引擎、大语言模型(LLM)和什么都不用三种方式写文章,同时监测脑活动。

结果发现,用LLM写作的学生,大脑活动降低了55%。而且,写出来的文章被评价为缺乏创造力,用研究者的话说——没有灵魂。一位老师对404 Media描述学生用AI做作业的状态:人去了健身房,然后让机器人替你举铁。

心理学家在另一篇论文里给出了更系统的解释:人工智能助手的设计目标就是模拟认知技能,因此持续、反复地使用AI助手,大概率会导致使用者自身技能的退化——而且越是认知负荷高的技能,退化越快。

对于大部分的大语言模型而言,你问它任何问题,它都能给你一个看起来很有说服力的答案。

问题在于:自己想清楚一个问题、推导出你认为最优的答案——这件事本身就是一种重要的能力,它叫作批判性思维。

一项针对商学院学生的研究发现,频繁使用AI工具与批判性思维能力之间存在显著的负相关:年龄越小的学生,对AI的依赖越强,批判性思维得分越低。一位受访者的自白很有代表性,「我太依赖AI了,离开它我可能都不知道怎么解决问题。」

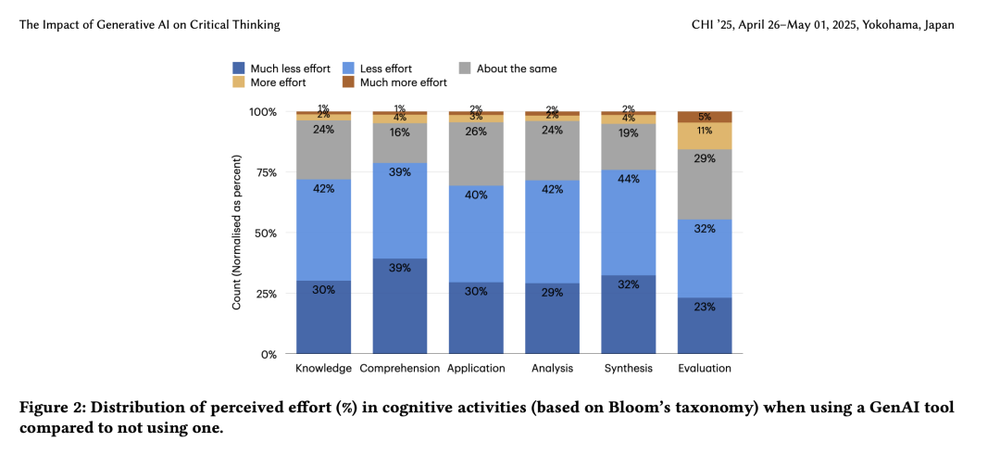

微软自己出钱做的一项研究(The Impact of Generative AI on Critical Thinking)则发现了一个更微妙的机制:知识工作者对AI工具越有信心,自己投入的批判性思考就越少。

信任AI,于是不再思考。不再思考,于是更依赖AI——闭环了。

AI不会取代你,会用AI的人会取代你——这句话流行了两年,但纽约大学教授Sonia Marciano提出的方差(variance)理论提供了一个不同的视角:在竞争中真正能拉开差距的,是那些既重要又困难的事。

有意思的是,造AI的人似乎也这么想。华尔街日报采访了几位AI行业的核心人物,问他们一个家长式的问题:你的孩子该学什么?微软首席科学家Jaime Teevan的回答是:培养批判性思维需要摩擦,需要做难的事,做深度思考。

Anthropic联合创始人Daniela Amodei则说,如果要引导自己的孩子,她会让他们多社交、多理解人与人之间的关系——造出Claude的人,给自己孩子的建议是远离屏幕去跟人打交道。

全世界都在说要学AI,但AI的缔造者们却在教自己的孩子做人。

用AI不难;不用AI开始变得越来越难。

自己写一篇有论点驱动的文章,难;对一个复杂问题形成原创观点,难;做批判性思考,难。而恰恰是这些「难」的事情,才是人和人之间真正的分野。

如果你选择把思考外包给AI,至少应该清楚你在付出什么代价——你自己的智力。