扫码打开虎嗅APP

本文来自微信公众号: 未尽研究 ,作者:未尽研究

被美国战争部以“供应链风险”封杀的Anthropic,一纸诉状,把五角大楼告上了法庭。与此同时,以谷歌首席科学家迪安(Jeff Dean)为首的约38位AI科学家、研究人员、工程师们,以个人的名义联名向法庭递交陈情书,表达对Anthropic的支持。他们全部来自OpenAI、谷歌DeepMind、谷歌。

媒体也报道,还未消气的特朗普,可能将正式发布一道行政令,把Anthropic这种“觉醒”的AI,从联邦政府的体系中剔除。

白宫和战争部双管齐下,将令Anthropic这家风头正健的公司遭受重大打击,可能造成数十亿美元的损失,而且对于一家正寻求上市的企业来说,在政府的黑名单上,也将成为其重大障碍。从某种意义上,Anthropic从法律上挑战五角大楼等美国政府部门、机构和个人,也是一种自救行为。

Anthropic的诉状,以及美国战争部副部长的回应,可以看到AI在进入战争这样性命攸关的场景之中,正在面临的一个新的悖论,它将因为对目标更精准更高效的打击,而减少平民的伤亡;还是有可能因为技术不成熟甚至脱离了人类的控制,而产生意外无辜的伤亡?人类会接受哪一个?界限在哪里?谁来划定?

2021年,7名前OpenAI员工离开OpenAI,创办了Anthropic。他们出于对AI安全(safety)方向的忧虑,从诞生第一天起,就把"负责任地开发AI、最大化对人类的积极影响"写进了公司章程。Anthropic还在特拉华州注册为"公益公司"(Public Benefit Corporation),这一特殊法律结构要求董事会将安全、伦理与社会影响纳入日常决策,而非唯利是图。

然而,命运的走向充满反讽。这家以"AI安全"为核心使命的公司,很快成为五角大楼这一全球最强大的军事机器最依赖的AI神经系统。

从2023年开始,Anthropic开始系统性地布局进入美国政府市场。公司加入了AI安全(security)研究所联盟,与联邦政府合作开展AI安全研究和评估框架建设。它与主要云服务提供商建立战略合作,并投入大量资源,获得了联邦风险与授权管理项目(Fed RAMP)的最高安全认证——这是云服务进入政府保密系统的入场券。

2024年,一个重要里程碑出现:Anthropic成为第一家与美国能源部合作、在最高机密环境中对AI模型进行测评的前沿AI实验室。这不是普通的商业合作,这意味着Claude已经站在了美国国家安全基础设施的门槛之上。

Anthropic还专门开发了"Claude Gov"系列模型——这是专为国家安全场景量身定制的版本,根据情报机构的直接反馈构建,具备对涉密信息的增强处理能力、对关键语言的更高精通度,以及对网络安全数据的精密分析能力。与面向普通用户的Claude不同,Claude Gov大幅放宽了在军事和情报语境下的使用限制:它可以处理涉密文件,可以执行军事行动分析,可以分析依法收集的境外情报——这些都是普通Claude被明确禁止的场景。

诉状中有一段话,罕见地披露了Claude在军事领域的具体能力:自主完成与攻防网络作战及漏洞检测相关的复杂软件工程项目、为军事行动提供支持、执行情报分析任务,乃至在专为保密网络定制微调的版本上处理国家安全工作流程。其中"进攻性网络作战"的表述尤为引人注目,这意味着Claude被用于主动的网络攻击任务,而不仅仅是防御性工作。

2024年底,通过与Palantir及AWS的三方合作,Claude正式进入战争部的保密系统。Palantir的Maven智能系统——美军目标识别和情报融合的核心平台——整合了Claude,开始在美国中央司令部和其他作战指挥机构中运转。到2025年中期,Anthropic与战争部首席数字和人工智能办公室(CDAO)签署了第一份直接协议,合同上限2亿美元,与Google、OpenAI和xAI所获合同金额相同。

至此,Claude已成为美国军方保密网络中部署最广泛的前沿AI模型,也是唯一一款在保密系统上运行的前沿AI模型。军方对其赞誉有加,称Claude具备"卓越"(exquisite)的能力——这是军方极少用于评价商业AI工具的措辞。

然而,这正是双方合作的顶点。

2025年秋,两家协议进入了关键的扩展谈判阶段。战争部希望将Claude部署到其"GenAI.mil"AI平台,这是一个覆盖整个军事体系的生成式AI基础设施。谈判桌上,国防部提出了一个新要求:放弃Anthropic的使用政策,改为允许战争部"以一切合法目的"(all lawful use)使用Claude,无任何额外限制。

诉状中详细记录了Anthropic的回应:公司大体同意了这一框架,唯独保留了两条限制。

第一条:禁止将Claude用于无人类监督的致命自主战争。

Anthropic在诉状中解释:Claude从未被开发或测试过用于自主致命战争。至少在目前阶段,Claude根本无法在没有人类监督的情况下可靠、安全地执行此类任务。这不是意识形态立场,而是技术判断,AI模型会有"幻觉",会产生错误输出,在高概率分布采样中无法保证与预定规则的一致性。明知存在可靠性问题,却将这一系统部署在"杀人决策"的核心,是技术上不负责任的行为。

第二条:禁止将Claude用于对美国公民的大规模监控。

Anthropic的理由同样基于技术现实:像Claude这样的AI工具能够以前所未有的速度和规模收集、分析信息,对公民自由构成独特威胁,且错误的潜在放大效应远超传统手段。现行的法律框架——那些规范行政部门监控行为的国会立法——是在AI技术尚不存在的时代制定的。AI正以远超法律框架更新速度的节奏发展,而AI驱动的监控犯错的可能性,以及错误被放大的能力,都远超传统监控技术。

在Anthropic看来,这两条限制并不是在干涉军方决策,而是对自身产品能力边界的诚实表达。诉状明确指出:使用政策"并未赋予Anthropic任何特殊能力来控制、监督或质疑联邦政府的运作或战争部的军事判断",也不让Anthropic处于任何可以干预或阻碍政府决策的位置。

在双方谈判期间,战争部从未就Claude的安全性或使用政策提出任何具体问题。相反,军方一直对Claude的使用反映正面,从未报告任何实质性的运营问题或安全关切。

2026年1月初,局势出现了转折。战争部长彼得·海格塞斯发布了一份内部备忘录,要求"在整个部门范围内释放美国领先AI模型的实验空间",并明确指令采购办公室:"在任何战争部AI服务合同中,于180天内加入标准的'任何合法用途'条款。"三天后,海格塞斯发表讲话,宣称战争部正在"炸毁……那些障碍"。

Anthropic对此依然保持合作姿态,继续就条款细节与军方周旋,并反复表达愿意继续服务国家安全利益的强烈意愿。

Anthropic称,但战争部选择了另一条路:诉诸威胁,而非谈判。

2026年2月中旬,战争部内部消息源向媒体透露,五角大楼"接近"切断与Anthropic的商业关系,并可能将其列为"供应链风险"——这一标签此前从未被公开用于美国本土公司。这名消息源的措辞异常露骨:"这将是一场极其痛苦的脱钩,他们为逼我们走到这一步,我们一定要让他们付出代价。"

与此同时,公开的人身攻击开始涌现。战争部官员将Anthropic的CEO达里奥·阿莫迪称为"意识形态驱动的人"、"骗子",说他有"上帝情结",说他"甘愿将国家安全置于风险之中"。战争部首席技术官则公开批评Anthropic的使用政策"不民主"。

2月23日,一名战争部高级官员向媒体描述了即将发生的会面:"这不是一次友好的会谈。这是一次'拉屎还是滚出马桶'(shit-or-get-off-the-pot)的会谈。"

当面摊牌

2026年2月24日,一场决定性的会面在华盛顿发生。海格塞斯与阿莫迪面对面坐下。据诉状记录,五角大楼官员事后向媒体确认,这次会面"并非为了推动解决方案,而是为了恐吓Anthropic"。

海格塞斯给出了最后通牒:在四天内服从,否则将面临以下惩罚:

其一,援引1950年《国防生产法》,强制征用Anthropic的技术,迫使其无条件为五角大楼服务。其二,将Anthropic列为"供应链风险",将其逐出国防供应链体系。

Anthropic认为:这两个威胁本身就构成了一个逻辑悖论——如果Anthropic真的是不可接受的安全风险,为何又要援引法律强制其留下?如果它对国防如此重要,为何要逐出供应链?诉状提供了这一细节:同一名官员在同一场合,既声称Anthropic对国家国防"必不可少",又声称其是"不可接受的国家安全风险"。

会面结束后,一名五角大楼高级官员向媒体宣布了截止时间:美国东部时间2月27日下午5点01分,不服从则援引《国防生产法》,且"战争部长将同时把Anthropic列为供应链风险"。

2月26日,阿莫迪发表公开声明,措辞克制而坚定:"Anthropic理解,做出军事决策的是战争部,而非私人公司。我们从未就具体军事行动提出异议,也从未以临时方式限制我们技术的使用。"他再次强调,两条限制所涉及的,是"当今技术无法安全可靠地完成的事情",Anthropic"无法以良知服从"战争部的要求。他同时承诺,如果战争部决定与Anthropic终止合作,公司将配合进行平稳的技术交接,"避免对正在进行的军事规划、行动或其他关键任务造成任何干扰"。

2026年2月27日,彻底摊牌的事件接连发生。

甚至在下午5点01分的截止时间到来之前,总统特朗普就率先出手。他在自家社交媒体Truth Social上发文,命令"美国政府的每一个联邦机构立即停止所有对Anthropic技术的使用"。他斥责Anthropic"失控"、是"激进左翼、觉醒公司",称其领导层是"左翼疯子",并威胁:"如果Anthropic不立即整改,我将动用总统的全部权力迫使其服从,并追究重大民事和刑事责任。"

海格塞斯紧随其后,在X(原推特)上发布"最终决定",宣布将战争部对Anthropic的定性为"国家安全供应链风险",并宣告"即刻生效,任何与美国军方有业务往来的承包商、供应商或合作伙伴,不得与Anthropic开展任何商业活动"。海格塞斯同时斥责Anthropic的"硅谷意识形态"、"有缺陷的利他主义"、"企业级道德表演"和"傲慢到极点的态度",并批评公司不够"爱国"。他还宣布Anthropic将被允许在未来最多六个月内继续向战争部提供服务,"以实现向其他AI提供商的平稳过渡"。

随即,联邦机构的多米诺骨牌开始倒下。

美国总务管理局(GSA)当天宣布,将Anthropic从USAi.gov和多项政府采购合同清单中移除,并终止了Anthropic的"OneGov"合同——这意味着联邦政府三个分支(行政、立法、司法)的政府雇员都将无法使用Anthropic的服务。财政部和联邦住房金融局公开宣布切断与Anthropic的一切合作。国务院和卫生与公众服务部据报道向内部员工发出备忘录,要求停用Anthropic的服务。各联邦机构的首席信息官纷纷向下属发出指令。实际上,Anthropic在诉状中列出了多达54家联邦政府部门、机构和个人。

私营部门同样陷入恐慌。Anthropic立即收到大量来自客户、云服务商和投资方的问询,他们对自己是否被允许继续使用Anthropic的产品感到困惑,并开始询问合同终止条款。数十家公司联系Anthropic,寻求澄清和指引。

3月3日,海格塞斯签署了正式的书面通知,确认战争部已"认定使用Anthropic产品构成供应链风险",且"危害较小的替代措施无法合理实现"。通知声明该认定"即刻生效",且将持续有效"直至战争部长以书面形式修改或终止"。

在整个谈判和对抗过程中,战争部从未就Anthropic的安全性,或Claude的能力,表达过任何实质性的担忧。

Anthropic认为,五角大楼对其发出的全部攻击,集中于一个词:意识形态。"Anthropic的立场与美国原则根本不相容"——赫格塞斯在宣布封杀命令时如此写道。一名官员则说:"达里奥的问题在于,对他来说,这是意识形态。我们知道我们在打交道的是什么样的人。"

但与此同时,这家被扣上"国家安全威胁"帽子的公司,其安全认证从未被撤销。Anthropic人员的安全许可至今仍然有效。战争部在发出封杀令的同时,还要求Anthropic继续提供六个月的服务,因为军方清楚地知道,在一场正在进行的战争(伊朗战役"史诗之怒"行动)中,替换Claude将是"庞大而困难"的工程,且至少在短期内,没有任何其他AI模型能够取代其在保密系统中的位置。

Anthropic称,所谓"供应链风险"的认定,历史上从未被公开用于美国本土公司,而是专门针对美国对手国家企业的标签。将其用于一家持有最高云安全认证、安全许可从未被质疑的美国公司,本身就是这套法律武器被政治化滥用的铁证。

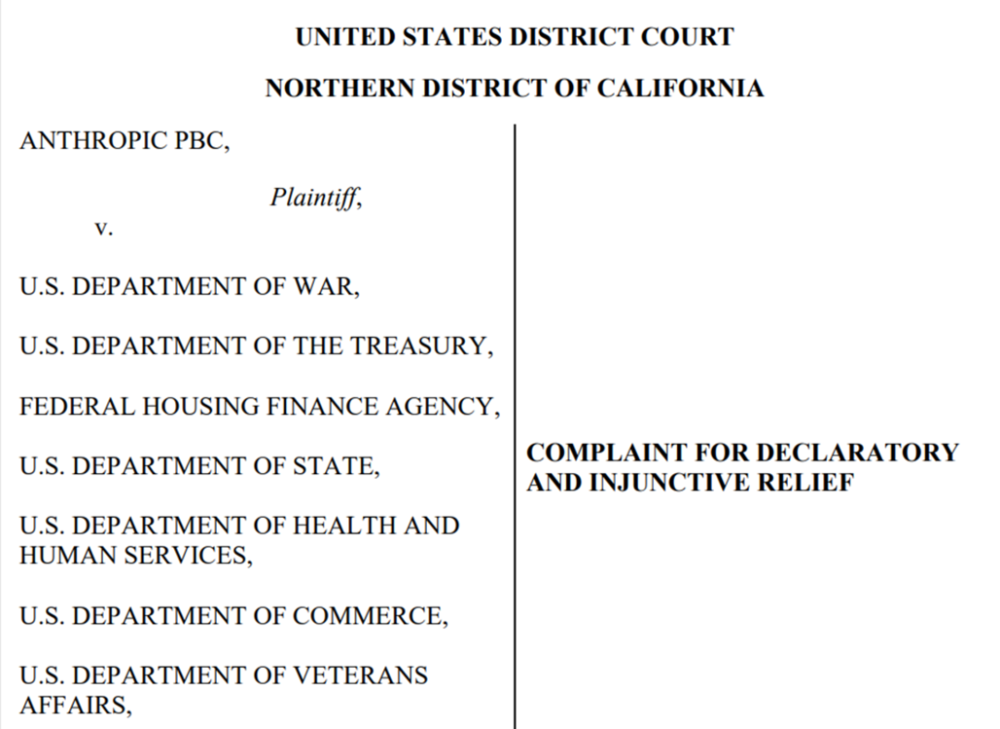

2026年3月9日,Anthropic在旧金山加州北区联邦地区法院提起诉讼,同日还在哥伦比亚特区巡回上诉法院提交了另一份诉状。被告名单长达十余个联邦机构和官员,包括战争部、财政部、国务院、国土安全部、总务管理局,以及以个人官方身份被起诉的海格塞斯、财政部长贝森特、国务卿卢比奥等。

诉状开篇即称:"这些被质疑的行政行为,既史无前例,又违法无据。"

五项法律挑战同时展开:违反授权法律(10 U.S.C.§3252)、违反宪法第一修正案(言论自由)、总统令超越行政权限(ultra vires)、违反宪法第五修正案正当程序、以及违反《行政程序法》对未授权制裁的禁止性规定。

第一修正案指控是整个诉讼的核心:联邦政府因一家公司公开表达其对自身AI产品局限性的真实判断,而动用国家权力对其实施毁灭性的经济惩罚。正如诉状所言:"宪法不允许政府挥舞其巨大权力,罔顾一家企业言论受到保护而对其施加惩罚。"

就在Anthropic发出起诉前几天,战争部副部长迈克尔(Emil Michael)接受了美国保守派媒体Pirate Wire的专访,提供了他的视角,也透露了一些美军使用AI的场景。顺便说一句,他之前在Uber任高级副总裁,主导了对滴滴的投资、与百度的合作,以及最终将中国业务卖给滴滴。

去年8月,负责研究与工程事务的美国战争部副部长迈克尔接管了五角大楼的人工智能事务。在熟悉工作的过程中,他先审视了Anthropic以及其他AI公司的合同条款,当即认为当初签署合同的拜登政府官员就像那位总统本人一样,“完全在打瞌睡”。

“我当时想,‘天哪,’”迈克尔说,“整整25页的条款,全是我不能做的事情。”

这些禁止事项包括:使用Anthropic的AI来规划动能打击。所谓动能打击(kinetic strikes),是指使用导弹或炸弹等物理力量实施的军事攻击,而不是通过网络、电子战或信息战等非物理手段,这通常被认为是战争中的核心活动。例如,战斗人员进行假设性的动能打击规划其实非常常见。但如果用Claude来做这件事,就会违反Anthropic的“服务条款”,他说。

“这种合同应该是GEICO保险公司签的,而不是战争部签的。”他补充说。

迈克尔开始与所有模型供应商重新谈判合同,“确保里面没有这些疯狂的条款”。

但与Anthropic的讨论很快变得非常艰难。“整整三个月都是激烈的拉锯式谈判,”迈克尔说。

在他看来,其中很大一部分时间都在解释战争部的基本工作方式,并逐一讨论各种具体场景。

迈克尔回忆,他们讨论了这样一个场景:夜晚的军事基地里,所有人都在睡觉。一群无人机突然袭击,成百上千架,无人能够抵御这样的攻击,而一个利用人工智能的防御系统可以用激光将它们击落。

对于这种情况,Anthropic团队同意在服务条款中给予例外,他说,“他们会说,‘哦,这个场景挺有意思。’”

于是迈克尔开始尝试设想所有可能出现的未来战争场景,以便在Anthropic的服务条款中为这些情况争取例外。

再举一个例子。“假设有一轮导弹以高超音速向我们袭来,我们只有90秒反应时间,而且有一种安全的方法可以拦截,但人类无法完成这件事,”迈克尔说。“他们就会说,‘好吧,也许这算一个例外,但每次出现这种情况你都得给我打电话申请例外。’我当时想,‘事情不是这么干的。’”

据Semafor报道,Anthropic将这种说法称为“明显不实”,但迈克尔表示,“房间里的20个人都可以证明这件事确实发生过。”

这些交流让人筋疲力尽。无论是假设什么情景,无论提出什么论点,Anthropic都坚持认为,任何超出其“服务条款”的情况都应该由Anthropic自己判断,或者“也许”可以给出例外。

“我们不断讨论各种场景,我最后说,‘各位,我不可能为一个拥有300万人的部门预先列出所有例外,也无法预测未来,’”迈克尔说。

迈克尔希望获得对这项技术所有合法用途的许可。

迈克尔称,战争部“是世界上最大的官僚机构”,与联邦航空管理局等其他监管机构之间,本来就已经存在各种限制、政策、安全认证测试等等。

但Anthropic依然不肯让步。在上周接受CBS News采访时,Anthropic CEO阿莫迪(Dario Amodei)表示,法律尚未“跟上”人工智能的一些问题:“目前来看,我们是最先在一线看到这项技术的人。”

“结果证明,他们就是无法走到那一步,”迈克尔说。

在迈克尔看来,Anthropic随后开始向媒体泄露合同谈判内容。一月份路透社率先报道此事。迈克尔认为其目的在于“吸引OpenAI的研究人才”,以及“争取那些反对特朗普的用户”。

他认为这些泄密之所以可疑,是因为在Anthropic与五角大楼讨论的众多问题中,媒体报道却只集中在两个议题上:“自主武器、类似《终结者》中天网那样的可怕世界,以及大规模监控”。他说,这些问题听起来格外骇人,同时也让特朗普政府显得居心叵测。

Anthropic担心其工具可能被用于监视美国公民,或在缺乏足够人类监督的情况下协助武器目标锁定。Anthropic的说法是,其技术目前还不够可靠,无法用于完全自主的武器系统,同时法律也尚未跟上AI在国内监控方面的潜在能力。

但迈克尔认为,这两个问题都是“转移视线的烟雾弹”。首先,关于监控。根据阿莫迪的说法,他们担心的是:政府购买的公开数据“可能被全部转录、解释并交叉分析,从而构建出许多甚至大多数公民的态度和忠诚度画像”。

迈克尔对此回应说:“呃,这不正是你们在做的事情吗?你们购买数据库,大规模抓取互联网数据,但我却不能这么做?这听起来有点荒唐。”

战争部确实会使用商业获取的数据来微调其AI系统部署,并构建更好的情报画像(例如理解人们的一般行为模式,并使用来自美国科技公司的数据进行训练)。

但他强调,战争部并不支持非法的国内监控。“在大规模监控这个问题上,我们不是FBI,也不是国土安全部,这不是我们的职责范围。”迈克尔说。

“所以把我们描绘成想做这种事情的机构是荒谬的,”他补充说。“我们不希望审查制度,不希望侵犯隐私,也不希望用临时编造的荒唐搜查令去突袭老百姓的家。”

不过,迈克尔也明确表示,五角大楼确实希望拥有自主武器能力,而且现在仍然如此。

他提到了军方提出的“金穹”(Golden Dome)计划,旨在建立一个导弹防御盾,其中一部分部署在外太空。一些太空资产将从轨道上拦截以五倍音速飞行的导弹——这种导弹通常很难被击中。

迈克尔说,在仅有的90秒反应时间内,在太空中部署人类来发现、瞄准并击落导弹是不现实的。如果系统要发挥作用,就必须实现自动化。

“而且你可能会使用AI来进行判别:这是诱饵吗?这是弹头还是弹体?根据它的轨迹,我应该使用哪种武器?”他说。

据迈克尔称,Anthropic在这一点上是可以接受的。但媒体中那种叙事反复出现:五角大楼正在推动这两种可怕目标。而这更加坚定了迈克尔的看法:这是一次“信息战操作”。

最终,挫败感不断累积。“如果你不希望AI做战争部该做的事情,那你为什么还要和战争部做生意?”他说。

迈克尔表示,双方谈判真正的“触发点”出现在委内瑞拉领导人尼古拉斯·马杜罗被抓捕之后。那次突袭行动涉及动能打击,并由Palantir执行,而Palantir使用了Anthropic的Claude模型。

行动结束后不久,据《华尔街日报》最早报道,一位Anthropic的高级高管联系了Palantir的某个人,想具体了解Claude在行动中是如何被使用的。

“他们当时是在试图获取机密信息,”迈克尔说,“这是绝对不允许的。”

迈克尔称,据说Anthropic暗示,如果他们不认可某次军事行动的方式,他们实际上可以“拔掉电源”,让行动无法继续。那位向五角大楼报告这一交流的Palantir高管,对未来完成军事行动感到担心。

“他们的意思是,如果他们不喜欢Claude在那次突袭中的使用方式,我们可能就违反了服务条款,他们可能随时撤回软件,或者设置护栏阻止行动发生。这非常可怕,因为那样就会让真实的人命处于危险之中,”迈克尔说。“这不是开玩笑。”

根据Semafor的报道,Anthropic表示这种关于其与Palantir交流的说法是“虚假的”,其发言人称,Anthropic从未向任何行业合作伙伴表达过担忧,“除了一些严格限于技术问题的常规讨论”。

迈克尔称阿莫迪的“政治局”拖慢了整个过程。“这不是我和达利奥两个人面对面的谈判,”他说,“每次我们讨论任何事情,他都要把问题带回去给他的联合创始人‘政治局’和他们的伦理委员会。”

“然后这个政治局会给出决定,接着又开始新一轮循环。这真的让人很烦。”

“我是在政府工作的,按理说我才应该是那个效率慢的人。”他补充说。

更让人恼火的是,上周晚些时候,当谈判已经开始破裂时,Anthropic甚至没有打电话沟通。

“做交易有一个基本规则。如果你打算退出交易,你应该打电话告诉对方:‘我们恐怕谈不拢了。’但在周五最后期限前的周四晚上,他们直接发了一篇博客,说谈判结束了,而我们前一晚还在交换各自的红线,”迈克尔说。

在那个周四晚的博客文章中,阿莫迪写道,Anthropic“在良心上无法接受”五角大楼提出的要求,即允许其AI模型用于“所有合法用途”。他还声称政府威胁要动用《国防生产法》,以迫使Anthropic让步。

迈克尔表示,在谈判过程中发布博客这一行为激怒了特朗普总统和战争部长海格塞斯。

第二天,特朗普下令所有联邦机构停止使用Anthropic技术,并在六个月内完成淘汰。五角大楼正式将Anthropic列为“供应链风险”。迈克尔说,这一限制只适用于企业在为战争部服务时使用Anthropic技术的情况。

“这并不意味着AWS不能在非国防用途上为Anthropic提供服务,”他说。

尽管如此,这一认定可能对Anthropic的业务造成“严重打击”。许多业内人士猜测,特朗普政府是在因为意识形态分歧而惩罚这家公司,甚至试图“摧毁”它。

但未来的军事体系将越来越依赖AI模型。从与迈克尔的谈话来看,他担心支撑这些模型的一些意识形态分歧可能会威胁士兵的生命安全。

“当时我真的担心,他们的模型会被编入他们自己的‘宪法’、他们的灵魂和政策偏好——这就是一种供应链风险,”他说。

例如,迈克尔设想了这样一种情况:Anthropic可能把自己的政策目标和意识形态嵌入模型之中,以至于交付给战争部的某些产品,例如使用Claude在物理、空气动力学和材料科学方面设计的导弹,可能被故意做成有缺陷的产品。

“比如,如果这是一个激光制导导弹,他们可能会让激光不起作用,因为他们认为导弹会击中他们不希望被击中的目标。”

“我不能接受一把枪因为他们不喜欢枪就无法工作,”他说,“我们使用枪,这是我们的工作。”

迈克尔表示,截至上周三,他仍在尝试修补关系,把这看作Anthropic的“最后一线生机”,“我们当时还在进行这些讨论”。

直到科技媒体The Information转载了一份阿莫迪此前一周发给Anthropic员工的内部备忘录。

备忘录中提到,政府不喜欢Anthropic的部分原因是公司没有给特朗普捐款,也没有对他进行“独裁者式的赞美”(迈克尔称这种说法“完全不属实”)。备忘录还指责刚刚宣布与五角大楼达成合作的OpenAI,其AI安全措施十分薄弱,更像是为了逢场作戏,安抚员工,而不是为了真正防止滥用。

“那就到此为止吧,”迈克尔说。交易终止。

“这让我觉得——虽然我不能完全确定——他们其实从一开始就不想达成协议。他们想扛起反政府、反军方的旗帜,而在这个分裂的国家里确实存在这样的受众,也许他们认为那是一个更有利润的市场,”他说。

“当时我就在想,善意在哪里?可靠性在哪里?而对战争部来说,和合作伙伴之间最重要的就是可靠性。因为一旦发生事情,就像过去这一周发生的那样,你必须依赖人、依赖供应商、依赖软件和硬件——必须能够正常运作,”他补充道。

随后,阿莫迪为那篇帖子语气过于激烈而道歉。在接受The Economist采访时,他表示,那条内部Slack信息是在公司被政府列入黑名单的同一天写的。那一天对公司来说几乎是历史上最具打击性、最令人“迷失方向”的日子之一。

“回头看,我现在不会讲那些的话,”他说。

迈克尔对Anthropic与五角大楼未来的关系并不乐观。不过,毕竟迈克尔曾是Uber的首席商务官。

“我对战争部负有责任。如果有办法确保我们能够获得最好的技术,我不会有任何个人情绪。但他们必须重新赢得信任,必须证明自己可靠,证明他们可以成为长期合作伙伴。因为随着我们越来越多地在工作中使用AI,就像任何大型组织一样,我们必须建立长期信任。这是最基本的原则。他们必须证明这一点。如果能够证明——虽然我不能代表部长或总统发言——但我会保持开放态度,”他说。

“毕竟,我是个做交易的人。”

但是,在Anthropic发起诉讼之后,迈克尔称,目前没有重开谈判的可能,并宣布五角大楼开始使用Gemini模型。

--

参考文件:

https://assets1.cbsnewsstatic.com/hub/cms/prod_cms_alt/file/2026/03/09/2c827022-6c4e-4ce4-8f65-bde71f962da1/gov.uscourts.cand.465515.1.0_1.pdf

https://www.piratewires.com/p/inside-pentagon-anthropic-deal-culture-clash