扫码打开虎嗅APP

本文来自微信公众号: InfoQ ,作者:褚杏娟

当地时间5月14日,Anthropic以中美AI竞争为由发布长文,呼吁进一步收紧芯片出口限制。

同一天稍早时候,路透社报道称,美国已批准约10家中国公司购买英伟达专为中国市场定制的H200芯片。报道提到的公司包括阿里、腾讯、字节、京东等。不过,这批许可尚未转化为实际交付。

Anthropic直接指出,训练前沿AI模型最关键的资源是先进芯片,也就是算力。美国目前的优势建立在NVIDIA、AMD、TSMC等“民主国家产业链”之上。但如果不进一步收紧管制,美国在2028年前可能会失去主导权,中国AI实验室的模型能力可能追到只落后美国几个月。

Anthropic还引用了一组数据,称按总处理性能计算,华为在2026年的算力产出仅相当于英伟达的4%,到2027年更是降至2%。

在Anthropic的框架里,中美AI竞争被拆解为四条线:第一是智能,即谁能开发出最强大的AI模型;第二是国内采用,即谁能更有效地把AI整合进商业和公共部门;第三是全球分发,即谁能部署支撑世界经济运行的全球AI技术栈;第四是韧性,即谁能在AI带来的经济社会转型中维持稳定和连续性。

其中,模型智能被认为是最重要的一条,而这也是Anthropic收入的重要基石。

Anthropic认为,当前中国AI实验室之所以仍能接近美国模型能力,主要依靠三类因素:世界级人才、先进算力,以及通过大规模“蒸馏攻击”提取其前沿模型能力。为此,Anthropic还提出,应明确将“蒸馏攻击”非法化,并加强情报共享;同时推动美国“可信AI技术栈”出口,抢占全球南方市场。

一边阻止先进芯片外流,Anthropic一边正在斥巨资解决自身面临的巨大算力短缺问题,同时通过频繁调整产品价格,让用户来承担算力短缺带来的影响。

在算力持续紧张的背景下,Anthropic再一次调整了定价策略。

近日,Anthropic宣布,从6月15日起,将把程序化Claude使用量与标准聊天订阅额度拆分开来。也就是说,开发者通过Agent SDK、GitHub Actions,以及OpenClaw等第三方智能体框架调用Claude时,将不再简单计入原有订阅套餐,而是进入一个独立的月度积分系统,并按照类似API的方式计费。

这一变化意味着,过去许多开发者用Claude Pro或Max套餐低成本运行自动化任务、智能体脚本、CI流水线和长期编码代理的方式,将面临重新定价。

根据Anthropic的安排,程序化使用的月度积分额度将与用户现有Claude订阅档位挂钩,大体对应其月费水平。其中,Pro用户每月可获得20美元积分,Max 5x用户为100美元,Max 20x用户为200美元。

在此之前,Claude的交互式聊天使用和程序化调用来自同一个订阅额度池。开发者不仅可以用高阶Claude套餐进行聊天、写代码、调试,也可以通过外部智能体框架运行自动化工作流。

正是这种“一个订阅覆盖多种用途”的模式,让Claude一度成为智能体开发者眼中的高性价比选择。尤其对于运行长期任务的开发者来说,通过OpenClaw、Agent SDK等工具调用Claude,实际成本往往低于直接使用API。

但Anthropic早在今年4月就已经释放信号。公司当时在X上表示,Claude订阅将“不再覆盖OpenClaw等第三方工具的使用量”,理由是算力容量受限。新政策落地后,开发者如果继续使用外部智能体框架,要么购买额外用量包,要么转向直接API计费。

有趣的是,Anthropic首席财务官Krishna Rao在采访中表示,“我们的定价一直比较稳定。无论是Haiku、Sonnet,还是Opus,价格都没有频繁调整。现在Mythos当然是比较新的模型,但总体来说,Anthropic很少改价格。过去最大的一次价格调整,是在推出Opus 4.5时,公司把Opus系列的价格降了下来。”

他解释当时的降价的原因在于,Anthropic发现Opus级模型的能力很强,但实际使用量没有完全匹配它的能力。很多客户明明遇到的是一个适合用Opus解决的问题,却会想办法把它塞进Sonnet的工作负载里。后来,由于模型效率上又有提升,从Anthropic的角度看,已经可以更高效地运行Opus,于是公司就把价格降下来,让客户更容易用上它。

这又回到一个核心点:Anthropic希望用户使用自己的模型,这也价格必须设在一个用户可以接受、并且能够从中获得足够价值的位置上。

Krishna认为,“Opus这次降价,其实体现了杰文斯悖论:Anthropic把价格降了下来,但使用量的增长远远超过原本预期。也就是说,因为价格落到了客户觉得合适的位置,他们开始更大量地使用Opus。而Anthropic也有足够的效率,可以支撑这种大规模使用。等客户把它真正接入自己的工作流之后,Anthropic再发布Opus 4.6,它就是一次模型升级,客户可以直接替换进去,而价格不需要再变。”

Krishna强调定价稳定很重要,但实际上,用户对价格有很强的敏感度,很反感Anthropic一而再再而三地调整价格策略。

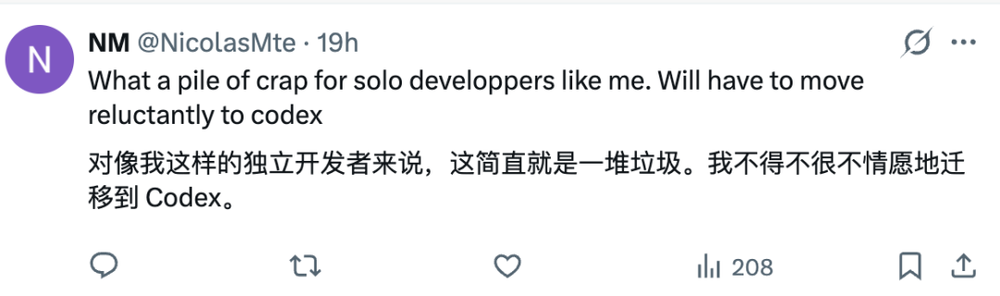

如之前调整一样,最新调整很快就引发了开发者不满。许多人认为,Anthropic正在削弱Claude对智能体工作流最有吸引力的一点:用相对稳定、可预测的订阅价格,支撑大规模自动化任务。

高级数据科学家Yadesh Salvi在X上批评称,Anthropic提供的月度额度“连一天的认真工作都撑不过去”。他认为,Claude Agent SDK和Claude Code中的claude-p等功能原本是用户高频使用的核心能力,如今却被压缩使用空间,还被包装成订阅福利。

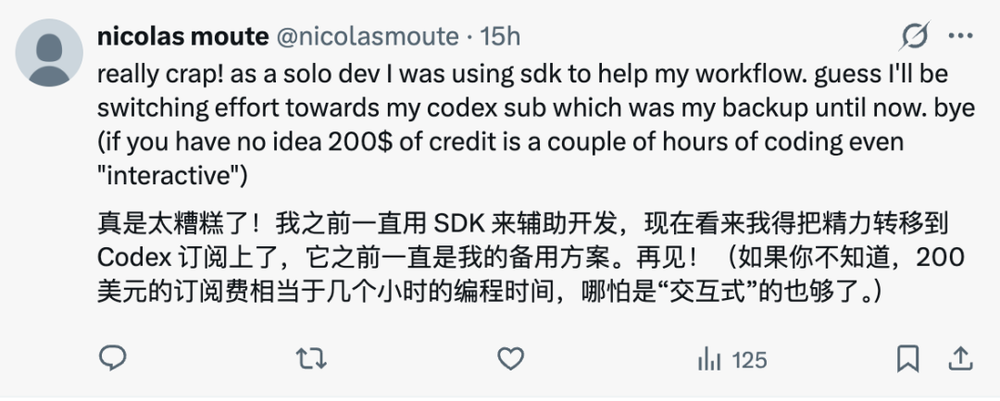

Broadcom高级站点可靠性工程师Advait Patel也表示,对于那些基于Claude Pro或Max固定价格套餐构建副业项目和个人自动化工具的开发者来说,新的独立积分池确实能给开发者一点试验空间,但一旦智能体足够有用、需要频繁运行,开发者就不可避免地进入按量计费模式。

“重度智能体用户消耗的算力,远远超过20美元或100美元订阅能够支撑的范围。”Patel认为,运行大模型本身确实昂贵,面向程序化使用的无限固定价格套餐,本来就很难长期持续。同样的钱,能跑的自动化任务变少了,想保持原来的使用强度,就要额外付费。

这场定价变化影响的不只是个人开发者,也会给企业带来新的成本管理问题。Patel指出,过去一些团队会依赖Claude订阅运行无人值守工作流,例如CI流水线、定时自动化任务和长时间运行的编码智能体。但在新政策下,使用量将更直接地与token消耗绑定,而不是简单跟订阅档位绑定。

这会让企业在预算预测上面临更大不确定性。尤其是那些涉及多次重试、大上下文窗口、多步骤智能体循环的工作负载,其token消耗可能快速膨胀。

更麻烦的是,Anthropic的积分是按用户分配的,不能在团队之间共享。这意味着企业无法轻松建立一个统一预算池来覆盖共享自动化任务。一个失控的智能体,或者一个设计不佳的提示词,都可能迅速烧光个人额度,导致任务中断或者开始产生额外费用。

高额的费用让微软也有了压力。据外媒报道,微软已开始逐步取消数千名内部开发者的Claude Code授权。尽管过去半年这个AI编程工具深受微软员工欢迎,但公司决定将重点收缩至自家的GitHub Copilot CLI。

微软向员工解释说,此举是为了将Copilot CLI作为其在“体验与设备”领域的主要代理命令行界面工具,但消息人士称,此举也与财务有关。6月30日是微软当前财年的最后一天,取消Claude Code许可证是削减运营开支的简便方法,以便在7月新财年开始时节省开支。

近几个月来,微软内部开发者更倾向于使用Claude Code而非GitHub Copilot CLI。对于内部员工来说,从Claude Code过渡到GitHub Copilot并非易事。微软一直鼓励没有编程经验的员工尝试使用Claude Code,以便设计师和项目经理能够快速构建原型。微软最初还希望员工同时使用Claude Code和GitHub Copilot,以便比较两者并提供反馈。

现在,微软的GitHub团队面临着巨大的压力,他们需要改进Copilot CLI,并力争超越Claude Code。

可以看到,Claude Code虽然得到了能力认可,但一旦价格超出用户负担,无论个人还是企业,都会考虑选择其他产品,这对Codex、Copilot们来说,也是一次机会。

拥有更多算力是Anthropic最直接的解法。

“我们采购的算力,基本就是整个业务的生命线。”Krishna也在近期参加播客节目时表示。

Anthropic近期大规模采购算力,也说明了这一点。该公司已经独家租用SpaceX Colossus 1超算中心;与AWS长期合作,锁定5GW Trainium算力,10年投入超1000亿美元;签约Google与Broadcom的下一代TPU长单,3.5GW算力将从2027年起交付。去年,Anthropic还宣布投入500亿美元自建美国AI基础设施,并同步加码Google TPU与Microsoft Azure算力。

值得一提的是,Krishna明确表示,公司内部并没有看到scaling laws放缓的迹象。

在Anthropic内部,scaling laws的讨论也与不同开发阶段密切相关。Krishna表示,公司会看模型在不同开发阶段的表现。比如,在一次预训练运行过程中,Anthropic可以从损失曲线上看到,这个模型和之前训练过的模型相比表现怎么样。这样一来,公司就能对模型能力有一个基本判断。

在强化学习阶段,也可以用类似的方式来看。还有一点同样重要,就是当客户真正拿到模型之后,他们看到了什么、在哪些地方发现了问题。这些痛点之后就会变成Anthropic的训练目标。

当然,在企业侧,Anthropic不会用客户数据来训练模型,但客户会告诉Anthropic一些很具体的反馈。比如:“我希望模型在这个方面更好”,或者“我在某个地方被卡住了”,Anthropic通常会按这个方向去做产品,因为公司会在研发侧持续推进,随着时间推移把这些能力提升上来。

所以,这里面其实形成了一个相互连接的循环。在内部,Anthropic会一直观察不同训练阶段的模型、不同版本的模型快照,把它们和自己的指标做比较,也会和外部模型做一些比较;最终,公司还会看客户怎么评价这些模型。

Krishna补充解释道,Anthropic确实非常相信scaling laws。“当然,很多scaling laws论文的作者本来就是Anthropic的创始人。但即便如此,公司内部其实也是一群带着怀疑精神的人。至少从目前看到的情况来看,scaling laws并没有放缓。”

因此,单从模型开发层面,Anthropic就有动力持续进行算力投入,更何况其背后还有众多用户。

“对公司来说,算力是最重要的资源,也是其他一切能力建立起来的基础。所以,到底要买多少算力,是公司里最关键、也最难做的决策之一。”Krishna解释称,算力买多了,公司可能会被成本拖垮;算力买少了,又没办法服务客户,也没办法继续站在技术前沿。某种意义上,这两个结果都很危险。

因此,对Anthropic来说,算力采购不是一个可以临时拍板的事情,它会带来非常现实的后果。公司不可能今天说要买一吉瓦算力,下周它就交付。很多事情都必须提前规划。

据Krishna介绍,Anthropic在思考算力问题时,会尽量用一套系统的方法来判断。公司会从具体需求往上推,建模型、预测未来可能需要多少算力。当然,这些预测有时候也会出错。公司还要判断,如果想继续保持在前沿,到底需要准备多少算力,并且尽量根据未来的发展去估算。

“等到真正去做算力采购交易时,灵活性就非常重要。”Krishna强调,Anthropic会把这种灵活性写进合同里,也会体现在后续使用算力的方式里。因为当业务进入指数级增长阶段,最关键的就是尽可能高效地使用手里的算力。

“即便到今天,我大概仍然有30%到40%的时间花在算力上。”他说道。

在Anthropic的语境里,灵活性有好几层意思。首先,公司不是只押注一种芯片平台。现在Anthropic同时使用三类芯片:Amazon的Trainium、Google的TPU,以及Nvidia的GPU。对公司来说,这些芯片可以在不同场景里相互替换、灵活调度。

Anthropic买来的算力,会被用在几类事情上:一类是模型开发,一类是内部使用,比如加速自己的产品和模型研发,当然还有一类是对外服务客户。无论是Trainium、TPU还是GPU,Anthropic都会尽量让它们覆盖这些内部和外部场景,而不是把某一种芯片固定死在某一种用途上。

但这种灵活性不是一开始就有的。Anthropic花了很多年时间,持续投入,才慢慢做到今天这个程度。Krishna认为,在所有前沿实验室里,Anthropic可能是最高效的算力使用者之一。

比如Anthropic刚开始用TPU的时候,Krishna记得大概还是第三代TPU。那是Anthropic第一次大规模使用TPU。很多人当时都不理解,觉得:“你们是不是疯了?大家都在用GPU,为什么你们不用GPU?”但Anthropic一直很重视这件事,因为公司的目标就是能够非常灵活地使用各种算力。

除此之外,Anthropic还会比较同一芯片平台的不同代际,看哪一代芯片最适合哪一种内部工作负载,然后把它放到最合适的位置上。也正因为这样,公司后来真正搭起了一套编排层。它的作用就是帮Anthropic灵活调度不同类型、不同代际的算力,并在这个过程中,把每一份算力的价值尽可能榨出来。

一方面,公司会贴近底层硬件做优化,尽量少被中间软件层限制,从而控制更多性能变量;另一方面,这也是一个与各方紧密协作的过程。比如,Anthropic和Amazon的Annapurna Labs团队合作非常紧密,也会参与影响这些芯片的路线图。

因为Anthropic认为,公司正在做的事情确实是在把这些芯片的能力推到极限。这也意味着,在Anthropic内部,一美元算力所产生的价值,比在其他任何地方都要更高。

Krishna坦言,今天在这些使用场景里,Anthropic其实都受算力限制。如果放在一两年前,突然给Anthropic一批不同类型的算力,公司确实很难马上消化掉。因为这些芯片平台彼此不一样,有些更难操作,有些在使用方式上也有自己的特点。

但今天不一样了。如果现在给Anthropic更多算力,公司会很快把它部署到不同的使用场景里。整体分配方式可能和今天差不多,但Anthropic现在已经更擅长快速启动、快速部署几乎任何类型的算力。Krishna认为,这也是公司的一个真正优势。

Anthropic已经宣布与SpaceX在Memphis的Colossus设施合作。这就是一个很好的例子,来证明,只要能拿到近期算力(near-term compute),Anthropic都会去寻找机会。

随着算力基数越来越大,这类近期算力在整体可用算力中的占比会越来越小,但Anthropic看它的核心标准是:这些可用算力能不能有效部署起来。

答案有时候是可以,有时候是不行。如果可以,Anthropic就会继续看它的经济回报:价格怎么样、能用多久、位置在哪里、属于哪种类型的算力,以及公司能不能高效地运行它。所以,Anthropic内部有一套评估流程。

这套流程也会用来评估长期交易。上个月,Anthropic和Google、Broadcom签了一个五吉瓦的TPU合作,从2027年开始。Anthropic也和Amazon签了一个最高五吉瓦的Trainium交易,这是一个超过1000亿美元的承诺,其中很多算力其实已经开始落地,并且会在今明两年里继续落地。

Krishna将其形容成一层层叠起来的“算力蛋糕”(layer cake):不同算力会在不同时间启动,能力也不一样,而Anthropic会非常动态地比较这些算力。对公司来说,算力随着时间变化的性价比非常重要,它什么时候能落地,以及公司认为它能在业务内部发挥什么作用,也同样重要。这里有很多变量需要一起优化:它是什么类型的算力、成本是多少、使用周期有多长等。Anthropic会用一套相当动态的方式去看近期算力、中期算力和长期算力。评估的核心大体相同,只是时间周期不同。

在评估算力时,Anthropic也会看每token成本、吞吐量和速度之间的取舍。Krishna提到,当Anthropic同时看三个不同芯片平台时,每个平台里面其实还有不同代际的芯片,比如TPU V5e、V6、V7,Trainium 2、Trainium 3,它们在性价比曲线上的位置都不一样。

接下来很重要的一点,是看公司准备怎么用这些算力。性价比当然重要,因为它直接关系到效率;但对某些使用场景来说,速度也同样重要。所以,Anthropic会把算力拆得非常细,细到它什么时候能交付、能交付什么能力。

这件事主要由Anthropic的算力团队主导,但整个公司也会密切配合,一起讨论哪些地方需要这些算力、具体是为了什么。比如,公司可能需要CPU来做强化学习,也可能需要更前沿的算力来运行最好、最快的模型,或者用来训练这些模型。所以,从Anthropic的角度看,算力怎么用,既取决于客户需求,也取决于一个非常细的问题:每种芯片最适合做什么,以及公司什么时候能够拿到它。

Anthropic现在想要达到的状态是:首先仍然要站在前沿,这是最重要的;其次要能够服务客户;同时还要有足够的内部算力来加速员工推进工作。

除了讨论怎么买算力,Anthropic也经常开会讨论算力怎么分配。Krishna认为,这套讨论方式和公司文化有关。Anthropic的文化非常强调协作,所以大家讨论算力分配时,也不是各自守着自己的“地盘”,更不是零和博弈,而是用一种非常协作的方式来推进。

但在模型开发这件事上,Anthropic会设一个不会低于的算力底线。也就是说,哪怕这会让服务客户变得更困难,或者不得不在某些地方采取一些不太常规的做法,公司仍然会继续做长期投入,去开发最好的模型。因为Anthropic认为,前沿智能的回报非常高,尤其是在企业领域。所以,分配给模型开发的算力,会有一个明确的下限。

而内部团队也会分走一部分算力。Krishna提到一个很有意思的点。如果公司对员工说,“你们不能再使用我们的模型了”,那么Anthropic分配给员工内部使用的这些算力,其实可以支撑数十亿美元的收入。

实际上,Anthropic现在内部90%以上的代码,其实都是由Claude Code写的。很多Claude Code本身,也是在Claude Code的帮助下写出来的。这一程度上解释了Anthropic为什么要把部分算力留给给内部使用,因为模型本身正在帮助Anthropic构建下一代模型。

Krishna表示,公司内部讨论算力分配问题时,每个团队都会说明:如果拿到这些算力,他们会用来做什么。接着,大家会非常开放、坦诚地讨论这些投入的回报该怎么看。因为Anthropic可以非常动态地分配算力,所以也能在相对较短的时间内做出调整和改变。

这期间,Krishna还强调了人的作用。拥有最好模型的人才,可以加速能力发展。

他解释称,Anthropic其实不太用“闭源”或“开源”来区分模型,而是会把模型分成“在前沿”和“不在前沿”。那些站在前沿的模型,显然正在捕获经济价值,也在为客户带来有意义的投资回报。Anthropic现在做的,就是继续围绕这个判断加大投入。这既意味着投入算力,也意味着投入那些能够用好算力、并且能够用Anthropic自己的模型来真正加速开发的人才。

不只模型,还包括构建在模型之上的产品。比如,Anthropic在一月发布了三十个不同的产品和功能。这个节奏也在加快。这部分也得益于公司把模型和现有人才结合起来,让人们能够更快、更有效地使用底层智能。这基本上就是Anthropic在产品侧的判断。

Krishna强调,Anthropic的核心仍然是一个研究实验室,是那些不断推动模型能力上限的事情。公司一切都建立在这套研究体系之上。

今天,这套研究体系确实已经被模型赋能了,但还不是完全由模型自己完成。随着时间推移,Anthropic认为模型会变得更强,也会在研究过程中提供更多帮助。但研究方向怎么定、优先级怎么排、哪些新领域值得探索,仍然需要最优秀的研究人才来判断和设定。模型的加入,是在进一步放大这些研究人才的能力。

所以,Krishna把模型看成一种放大器:它不是取代Anthropic已有的人才,而是在强化和加速这些人才。人们经常说,人才密度比人才规模更重要,Krishna认为在这里同样成立。

Anthropic真正想要的,是聚集最优秀、最密集的一批AI研究人才和推理工程人才,再用最好的模型放大他们的能力。Anthropic认为,这会形成一个非常有竞争力的组合。

Krishna透露,Anthropic看算力投入,不会只看某一项具体成本,而是看整块算力支出到底能带来多少回报。这里说的“整块”,包括各种用途:服务客户、模型开发、内部提效等等。可以把它们理解成在不同时间尺度上支持收入增长的事情。

比如,现在用算力做推理,它直接支撑今天的收入;如果把算力用在模型开发上,它可能会在六个月后带来新的模型能力,打开新的市场空间,进而推动未来收入增长;如果把算力用于内部提效,帮助团队更快推出新产品,这本质上也在支持收入。

所以,Anthropic真正看的不是某一笔算力花费本身,而是整个算力池的总体回报。至少从今天来看,Krishna认为Anthropic在算力上的投入回报是很稳健的。公司一方面要为客户创造价值,另一方面也要确保自己能从算力投入中获得足够强的回报。站在这个角度看,Anthropic对目前的位置比较有信心。

再看第一季度的收入增长,那段时间收入涨得很快,但并不是因为Anthropic突然上线了一大批新算力。算力通常是按照很早以前就确定好的节奏逐步到位的,很多时候这个节奏可能在十二个月前就已经定下来了。

所以,在Krishna看来,如果把服务每一个客户都简单理解成一笔“新增变量成本”,其实不太适合Anthropic的业务。那更像是在用传统软件公司的逻辑来套它,但真实情况不是这样。

他解释称,算力不是只对应某一个客户、某一项成本,它同时支撑客户服务、模型研发、内部提效等一整套活动。而Anthropic衡量的核心,就是这整套算力投入到底能不能带来稳健回报。因此,Anthropic会把现有的算力池看成一个关键约束条件。它决定了公司短期能服务多少客户、长期能推动多少模型和产品能力,也决定了最终能带动多少收入。

Amazon、Google、Microsoft都是Anthropic的重要合作伙伴,Broadcom和Nvidia也是如此。Krishna表示,Anthropic的生态系统很强。今天,Anthropic是唯一一个同时出现在三大云上的模型,也是唯一一家使用这三种芯片平台的语言模型实验室。

“这些合作远远不只是采购。”Krishna认为,这一点经常被忽视。

比如Anthropic和Amazon的关系,Anthropic的团队和Annapurna Labs团队是深度绑定在一起的。Anthropic非常擅长使用Trainium,也投入了大量时间和精力,和Amazon团队密切合作,双方会一起做容量规划。

“再看三大云,它们对Anthropic来说也是非常好的分发渠道。”Krishna进一步解释道,“当然,Anthropic自己的一方业务也非常强。但总体来看,这些合作关系都是多维度的,不只是买算力这么简单,包括了芯片本身的开发、容量落地、服务交付,最后还包括把这些能力分发给客户。”

参考链接:

https://www.anthropic.com/research/2028-ai-leadership

https://www.reuters.com/business/retail-consumer/us-clears-h200-chip-sales-10-china-firms-nvidia-ceo-looks-breakthrough-2026-05-14/

https://www.infoworld.com/article/4171274/anthropic-puts-claude-agents-on-a-meter-across-its-subscriptions.html

https://www.theverge.com/tech/930447/microsoft-claude-code-discontinued-notepad