扫码打开虎嗅APP

本文来自微信公众号:财经E法 (ID:CAIJINGELAW),作者:殷继,原文标题:《App“监听用户”投放广告?这其实是个错觉》,题图来自:《窃听风云2》

你和朋友刚讨论完新出的运动鞋,打开手机,立刻就收到了淘宝的推荐;你和朋友电话里定好今晚酒吧聚会,很快,附近酒吧和餐厅的推荐广告就频繁出现在你常用的App中。

“我觉得App可能在监听我们的对话,要不然为什么总是有那么多巧合?”家住北京的王悦说,之所以让她感到担忧,是有一天夜里她在客厅和男友讨论点外卖吃小龙虾,接着她的生活服务类App首页推荐都是小龙虾。

“可能是种巧合吧,感觉App不太可能通过麦克风来监听我,它们应该主要根据我的所在城市、搜索、浏览的东西来向我推送广告。”李强在深圳从事IT工作,在他看来,App用设备麦克风监听用户不太划算。“要实现这种效果,首先要识别用户说了什么再进行语义分析,有时候苹果Siri都听不清你说的话,更何况那些App。”

如果App没有监听用户说话,用户在手机上收到的广告为什么越来越精准?怎么会有那么多的巧合?如何避免App违规使用个人信息和隐私?又有哪些技术手段可以保护用户个人信息和隐私不被滥用?

接受个性化推荐,无需付出隐私代价

如今,人们的生活离不开算法推荐技术,电商在618购物节向你推送“可能感兴趣”的商品;抖音根据你的点赞行为推荐更多你“可能喜欢”的视频;搜索引擎也根据你的点击操作进行检索过滤、排序精选,展示出你可能想要看到的搜索结果。

个性化推荐是算法推荐应用中最普遍的场景,它通过对用户兴趣偏好进行分析,组合不同画像的特征,实现向用户分类推送可能符合其喜好的产品或内容。例如,亚马逊、淘宝等电商平台,依靠个性化广告所带来的订单转化率已经逐渐超过传统的营销方式,这足以显示个性化推荐运用之广泛。

用户对于算法的态度如何呢?德勤2021年《数字媒体趋势报告》对2009名美国消费者的调查显示,在不同的平台和群体中,人们对广告的容忍度有很大差异。例如,在社交媒体平台上,62%的Z世代和72%的千禧一代更愿意看到针对自己喜好的个性化广告,而不是普通广告。

根据对外经济贸易大学数字经济与法律创新研究中心、中国人民大学数字经济研究中心和蚂蚁研究院共同发布的《算法应用的用户感知调查与分析报告》指出,虽然超八成受访者希望企业提供个性化推荐服务,但是超半数受访者不了解企业使用算法的内容和目的。另外,近八成受访者认为算法应用可能损害消费者权益,超六成认为会侵犯隐私。

那么,接受算法推荐服务,用户是否必然牺牲个人信息和隐私?

对外经济贸易大学数字经济与法律创新研究中心执行主任张欣在接受财经E法采访时表示,个性化广告推送并不一定非要以牺牲用户个人信息和隐私为代价。一方面,推荐系统在设计和应用时完全可以通过一系列技术最大化保护用户的隐私信息;另一方面,如果用户的选择退出权、标签删除权、反对权、知情权等各项权利能够得到切实保障,那么个人信息和隐私也能够在个性化广告推送实践中得到稳妥保护。

通过“监听”投广告,可能只是错觉

个性化广告的精准推送,是否如一些人所担忧那样,是通过用App“监听用户”实现的呢?其实,依靠用户画像进行的个性化推荐会与用户近期的行为数据、操作行为相关联,以至于产生“被监听”的错觉。

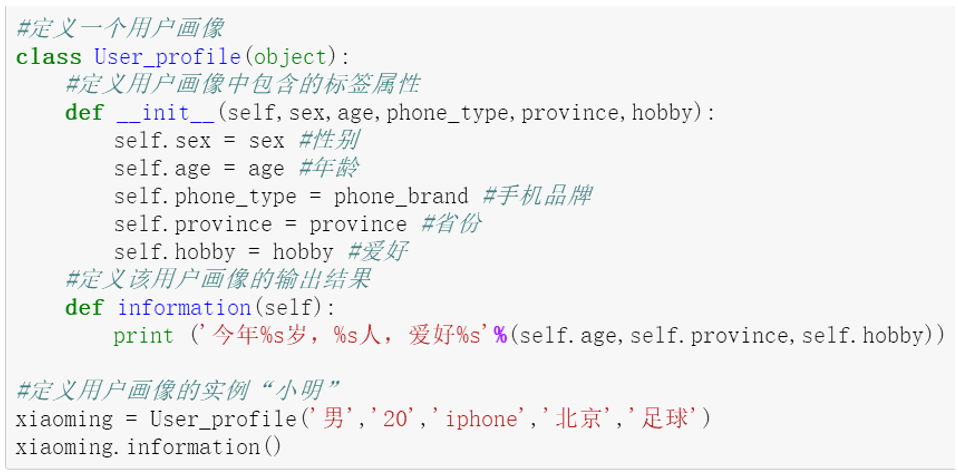

用户画像数据为结构化的字符串数据

根据《财经》商业治理研究院与中国社科院大学互联网法治研究中心联合发布的《个性化广告合规发展研究报告》介绍,从技术上来看,App可以调用“麦克风权限”实现对用户监听的功能,但App开发者会面临极大的法律风险甚至涉嫌犯罪。

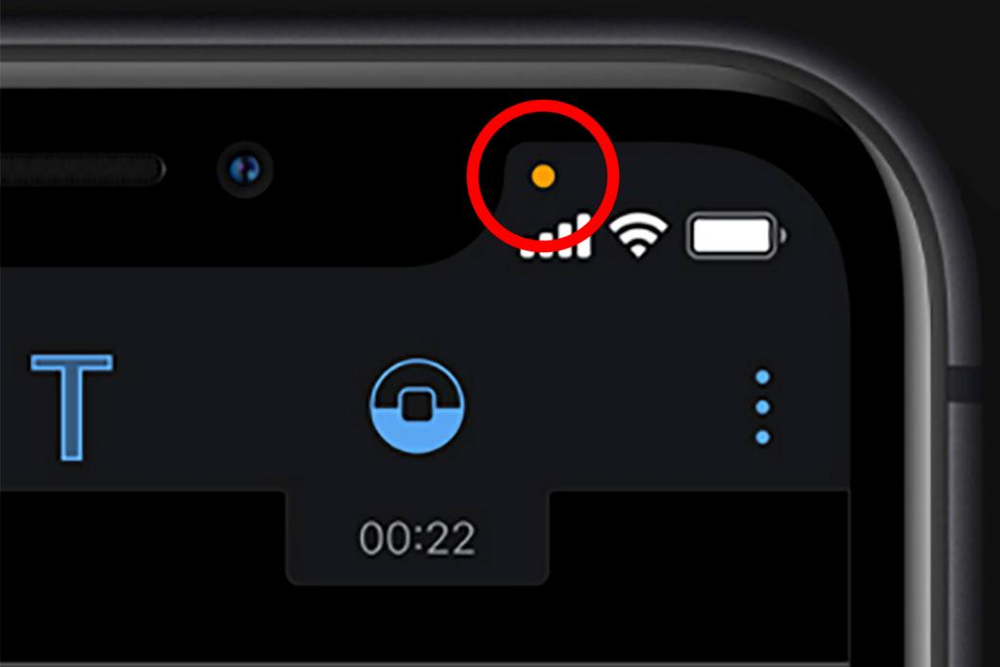

另外,在iOS和Android系统中,App调用“麦克风权限”需要获得用户授权,并且在功能使用中对用户进行强提示,用户极易感知监听带来的设备发热、耗电速度快等异常。

苹果iPhone会实时显示麦克风权限正在被调用

《计算广告》作者刘鹏认为,App如果无法获取iOS、Android系统的麦克风权限,除非拿到硬件芯片的访问权才可以实现监听用户,但硬件芯片的访问权在手机厂商手中,他们没有任何动力向不相关的App开放这个权限。“通过‘监听用户’来投放广告有些得不偿失,这是种非理性的行为。”

“在实验室测试环境中,我们模拟出了App在锁屏后也能持续录音一段时间的情况,但这种做法成本高、效率低、法律风险大,从此前了解到的检测结果来看,尚未发现有App这样做。”中国电子技术标准化研究院网络安全研究中心测评实验室副主任何延哲认为,更为高效、成本低廉的方式就是大数据的关联分析而非直接监听。

对数据进行挖掘分析,并用于个性化广告投放,在业内已形成通用且成熟的一套解决方案。目前,域内外法律及标准对个性化推荐进行明确的规制,且赋予个人信息主体的“拒绝权”,即如果反对使用自己的相关信息用于个性化广告以及算法推荐服务,用户有权选择关闭,来降低接收的广告与兴趣偏好的相关度。

隐私计算或可化解担忧

2021年,在国家网信办、工信部、公安部、市场监管总局(下称“四部委”)发起的个人信息保护专项整治中,对208万款APP进行了技术检测,通报违规1549款,下架514款。

2022年3月1日,四部委联合发布的《互联网信息服务算法推荐管理规定》(下称《算法推荐规定》)施行。其中,明确要求算法推荐服务提供者保护算法知情权、算法选择权等用户权益。

“《算法推荐规定》是第一部系统的、全面以算法为调整对象的规范性法律文件。从体系性、规制工具箱的丰富性、调整算法的多样性、对用户权益保护的周全性等多个层面来说,这个文件都具有开创性意义。”中国政法大学数据法制研究院教授张凌寒表示。

在个性化广告领域,根据现有的法律规范以及相关标准,网络服务提供者对用户具有“告知-同意”义务,告知收集个人信息的目的、方式及范围,获得用户的授权同意。其中算法推荐服务提供者,还应当给予用户拒绝使用个人信息投放信息的选项。另外,部分团体标准与行业规范也专门就定向广告、精准营销的个人信息使用行为作出了具体的技术要求。

前述《个性化广告合规发展研究报告》显示,各国立法者对强化个人在算法中的自主性已成共识。通过赋予了数据主体一系列权利,希望个体通过选择权和控制权,弱化人在算法社会被不断异化的趋势。同时,规制算法歧视需要从法律、道德以及社会可接受的角度来衡量,往往需要跨学科、多部门协作,形成政府监管、行业自律和社会监督的“共享、共建、共治”综合治理方案。

中国信通院泰尔终端实验室数字生态研究与治理中心主任杨正军认为,个性化广告以及个人信息保护的推进需要兼顾用户认知、行业水位和监管的尺度。

此外,外部的合规要求也助推着隐私计算技术的发展,这类技术旨在数据隐私保护的前提下,实现“数据可用不可见,数据不动模型动”。目前,各方在研究及落地应用的有“联邦学习、安全多方计算、可信计算”等隐私计算技术体系。

《个性化广告合规发展研究报告》指出,随着域内外逐渐完备的立法以及趋严的监管,正在推进企业实现更高的个人信息及隐私保护,随着隐私计算技术的发展,将逐步降低用户对隐私侵犯的担忧,成为平衡用户体验和个性化广告产业发展的保障。

本文来自微信公众号:财经E法 (ID:CAIJINGELAW),作者:殷继