扫码打开虎嗅APP

本文来自微信公众号:智东西(ID:zhidxcom),编译:云鹏,编辑:心缘,原文标题:《OpenAI连甩5款新模型!价格暴降,功力大涨,还修复了GPT-4变懒问题》,题图来自:视觉中国

昨夜,OpenAI发布了一系列重磅大模型更新,连发了五个新模型以及新的API使用管理工具,总体来说可以说是“加量不加价”,OpenAI的友商们一觉醒来压力着实又大了不少。

首先,来看看新品和新特性:

1. 新的GPT-3.5 Turbo模型,输入价格暴降50%,输出价格降低25%,同时修复各种BUG,回应准确性更高,老用户两周后还可自动升级!

2. 新的GPT-4 Turbo预览模型,生成代码能力更强,模型“变懒”情况减少,修复各种BUG,带有视觉功能的GPT-4 Turbo也会在未来几个月内推出!

3. 新的小型文本嵌入模型text-embedding-3-small,性能小幅提升,价格直接“打骨折”,暴降至上代的五分之一。

4. 新的大型文本嵌入模型text-embedding-3-large,核心就是性能强,可创建多达3072维的嵌入,部分测试性能提升70%以上,价格略贵一点点。同时,OpenAI还搞了个新技术,直接让开发者在略微损失精度的情况下缩短嵌入,实现性能和成本的平衡,灵活性极大提升。

5. 新的审查模型text-moderation-007,OpenAI将其称之为“迄今为止最强大的审查模型”。

新的API使用管理工具我们不在此赘述。

最后,OpenAI还很贴心地提示说,默认情况下,发送到OpenAI API的数据将不会被用于训练或改进OpenAI模型。话不多说,我们具体来看看今天各个重磅新品的升级细节。

一、五分之一的价格,更强的性能,模型使用灵活性显著提升

首先来看看OpenAI此次新推出的两个嵌入模型,更小且高效的text-embedding-3-small模型,以及更大且更强的text-embedding-3-large模型。

在看模型之前,首先要理解下什么是“嵌入(embedding)”,简单来说,嵌入是一系列数字,而这些数字代表了自然语言或代码等内容中的概念。

▲嵌入(embedding)示意图

嵌入让机器学习模型和其他算法能够理解内容之间的关系,并执行如聚类或检索等任务,为ChatGPT和Assistants API中的知识检索,以及许多检索增强生成(RAG)开发者工具提供了支持。

新的小型文本嵌入模型text-embedding-3-small相比于2022年12月发布的前代模型text-embedding-ada-002主要有两方面升级:更强的性能、更低的价格。

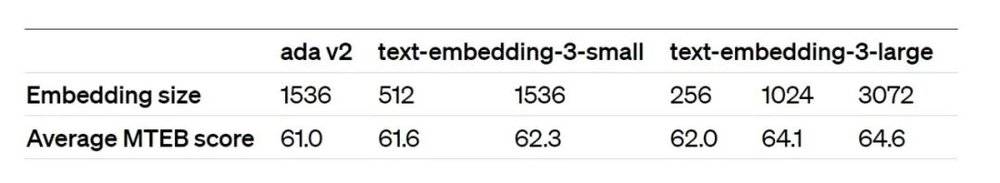

性能方面,在一个常用的多语言检索基准(MIRACL)测试中,text-embedding-3-small平均分数从31.4%增加到了44.0%,在一个常用的英语任务基准(MTEB)测试中,其平均分数从61.0%增加到62.3%。

▲text-embedding-3-small测试成绩

▲text-embedding-3-small测试成绩

价格方面,text-embedding-3-small的价格仅为上代的五分之一,每1000个tokens的价格从0.0001美元降低到0.00002美元。

另外一个新的大型文本嵌入模型text-embedding-3-large,据称可以创建多达3072维(dimensions)的嵌入,其主要提升在于性能。

性能方面,text-embedding-3-large在MIRACL测试中的平均分数从31.4%增加到54.9%,而在MTEB测试中,其平均分数从61.0%增加到64.6%。价格为0.00013美元/1000 tokens。

众所周知,用更大的嵌入,会消耗更多的计算、内存和存储资源,比使用更小的嵌入成本更高。

为此OpenAI推出了一种新的技术,让开发者可以在使用嵌入的性能和成本之间进行权衡。具体来说,开发者可以通过调整维度API参数(dimensions API parameter)来缩短嵌入,同时保证嵌入不会失去其表示概念的属性。

比如,在MTEB基准测试中,一个text-embedding-3-large嵌入可以被缩短到256的大小,但其测试成绩仍然优于一个未缩短的、大小为1536的text-embedding-ada-002嵌入。

▲缩短到256大小的text-embedding-3-large与未缩短的、大小为1536的text-embedding-ada-002测试成绩对比

这样的特性可以让使用变得非常灵活。比如当开发者使用一个最多只支持1024维嵌入的向量数据存储时,他仍然可以使用性能最强的text-embedding-3-large模型,他只需要为维度API参数指定一个1024的值,将嵌入从3072维缩短,当然精度会略有损失。

二、两大经典产品重磅升级,模型更勤快,代码能力增强,后续还会支持视觉功能

1. 新的GPT-3.5 Turbo模型:输入输出价格大幅下降,老用户升级方便

除了两个嵌入模型,这次OpenAI还宣布将在下周推出一个新的GPT-3.5 Turbo模型——gpt-3.5-turbo-0125,并且进一步降低其使用价格,这已经是过去一年时间里OpenAI对其进行的第三次降价了。

到底有多便宜呢?gpt-3.5-turbo-0125输入的价格降低了50%,为0.0005美元/1000 tokens,输出价格也降低了25%,为0.0015美元/1000 tokens。

当然,gpt-3.5-turbo-0125还会有各种升级,比如在以请求的格式回应时,会有更高准确性,同时OpenAI还修复了一些BUG。

另一个好消息是,使用pinned gpt-3.5-turbo模型alias的老客户将在新模型发布后的两周内自动升级。

2. 新的GPT-4 Turbo预览模型:代码更强,减少“变懒”

除了GPT-3.5 Turbo,OpenAI这次还发布了新的GPT-4 Turbo预览模型——gpt-4-0125-preview。

这个模型可以比之前的预览模型更完整地完成像代码生成这样的任务,并且可以减少模型“变懒(laziness)”不完成任务的情况。去年年底,GPT-4被发现“变懒”问题愈发严重,出现回应速度慢、回答敷衍、不听指令、写代码爱省略甚至拒绝回答、中断会话等情况。 当然,新模型也修复了一些BUG。

对于新的GPT-4 Turbo预览模型,OpenAI也引入了相关自动升级机制,如果用户订购了相关服务,他就会一直能够使用最新版的GPT-4 Turbo预览模型。

值得一提的是,OpenAI还提到他们计划在未来几个月内推出带有视觉功能的GPT-4 Turbo。

3. “迄今为止最强大的审查模型”

最后一个新产品是一个新的审查模型——text-moderation-007,OpenAI称之为“迄今为止最强大的审查模型”,免费的审查API可以允许开发者识别可能有害的文本。

4. 两项平台改进,提升开发者API使用管理体验

此外,OpenAI正在推出两项平台改进,让API密钥的使用有更好的透明度,同时让开发者对API密钥有更多的控制权。

第一项改进是,开发者可以从API密钥页面为API密钥分配权限。第二项改进是,使用仪表板和使用导出功能在打开跟踪后可以显示API密钥级别的度量。

▲仪表盘可以显示API密钥级别的度量

这样一来,只需要为每个功能、团队、产品或项目分配单独的API密钥,就可以简单地查看每个级别的使用情况。

三、结语:性能更强价格更低,OpenAI大模型继续巩固优势

此次OpenAI发布的多款大模型新品,都在上代产品基础上实现了一定的性能提升,在开发者使用的便捷程度、灵活程度上有一定改进,同时在价格方面给予了不小的优惠。

对于OpenAI来说,大模型生态的完善离不开开发者,今天的一系列“加量不加价”的操作也势必会增加OpenAI产品的竞争力。OpenAI的对手们将会做何应对、未来视觉大模型的出现又会给产业带来哪些新变量,我们拭目以待。

本文来自微信公众号:智东西(ID:zhidxcom),编译:云鹏,编辑:心缘