扫码打开虎嗅APP

本文来自微信公众号:有新Newin(ID:NewinData),作者:有新,原文标题:《AI 黑马 Groq 颠覆英伟达 ?LPU 性能与成本解读》,题图来自:视觉中国

Groq 是一家技术公司,由 Jonathan Ross 在 2016 年创立。Ross 曾是 Google 第一个张量处理单元(TPU)的创造者,他的创立理念源于一个观点:芯片设计应从软件定义网络(SDN)中吸取灵感。

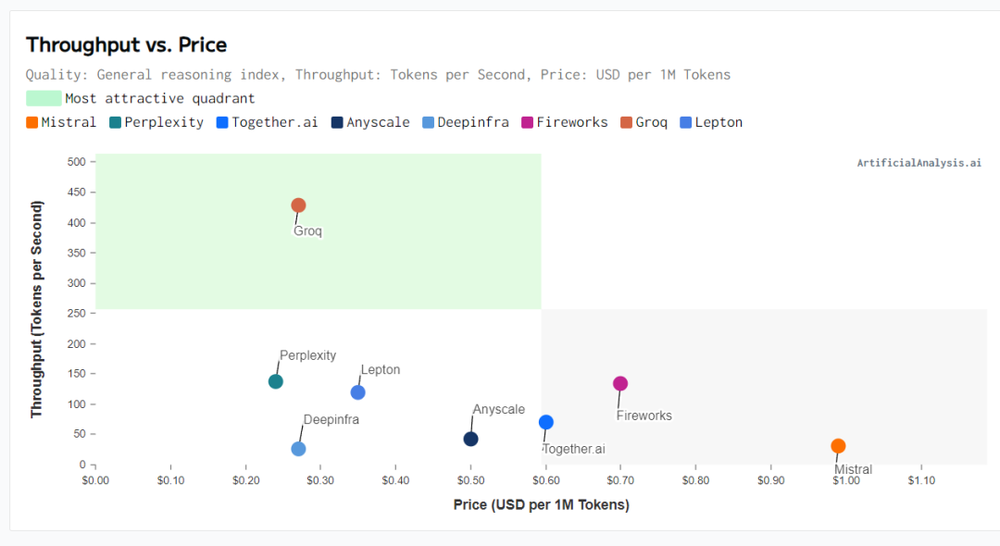

2024 年 2 月 13 日,Groq 在 ArtificialAnalysis.ai 最新的 LLM 基准测试中明显获胜,Groq 在延迟与吞吐量等关键性能指标上击败了八名参与者,Groq 处理吞吐量达到其他推理服务的 4 倍,同时收费还不到 Mistral 自己的 1/3。

图/ArtificialAnalysis.ai

ArtificialAnalysis.ai 联合创始人 Micah Hill-Smith 表示,Groq 代表了可用速度的进一步变化,为 LLM 提供了新的用例。

Groq 创始人和CEO Jonathan Ross 表示,Groq 的存在是为了消除“贫富差距”,并帮助 AI 社区中的每个人蓬勃发展。此外,他还表示,推理对于实现这一目标至关重要,因为速度是将开发人员的想法转化为业务解决方案和改变生活的应用程序的关键。

关于 Groq 的核心团队、合作伙伴以及投资方如下:

核心团队:

图/Groq

合作伙伴:

图/Groq

投资方:

图/Groq

Groq 最新一轮 3 亿美元 C 轮融资追溯至 2021 年 4 月,而不是 ChatGPT 发布后的一年多,这一轮投资者包括老虎、D1 以及 Alumni Ventures。

Groq 创新的核心在于其 LPU,旨在以前所未有的速度加速 AI 模型,包括 ChatGPT 等语言模型。

LPU 推理引擎(LPU 代表语言处理单元™)是一种新型的端到端处理单元系统,可为具有顺序组件的计算密集型应用程序提供最快的推理,例如 AI 语言应用程序(LLM)。

LPU 旨在克服 LLM 的两个瓶颈:计算密度和内存带宽。就 LLM 而言,LPU 比 GPU 和 CPU 具有更大的计算能力。这减少了每个单词的计算时间,从而可以更快地生成文本序列。此外,消除外部内存瓶颈使 LPU 推理引擎能够在 LLM 上提供比 GPU 好几个数量级的性能。

与利用高带宽内存(HBM)的 GPU 不同,Groq 的 LPU 利用 SRAM 进行数据处理,从而显著降低能耗并提高效率。GroqChip 的独特架构与其时间指令集相结合,可实现自然语言和其他顺序数据的理想顺序处理。

图/Groq

根据 Groq,开发者使用它的最快方法如下:

GroqCloud:请求 API 访问权限 以在基于令牌的定价模型中运行 LLM 应用程序;

Groq 编译器:编译当前应用程序以查看详细的性能、延迟和功耗指标。通过客户门户请求访问权限。

此外,开发者也可向 Groq 直接购买硬件。根据合作伙伴 Bittware 介绍,GroqChip 独立芯片是一款从头开始的可扩展处理器,以加速 AI、ML 和 HPC 工作负载,该架构比 GPU 简单得多,而且是以软件为先的设计,使其更容易编程,并以较低的延迟提供可预测的性能。

图/Groq

在软件定义网络中,通用硬件配合软件层来处理路由的复杂性,避免了使用专门的硬件。这一理念也体现在 Groq 的技术和其论文《用于大规模机器学习的软件定义张量流多处理器》中。

Groq 采用了一种从编译器开始的方法,编译器将代码转换为芯片能理解的机器语言。其目标是将机器学习算法简化,使之能在极其简单的处理器上运行,同时运行速度快且不会引发现代处理器中常见的昂贵内存调用和预测失误。

Groq 的芯片区别于传统使用高带宽内存(HBM)或动态随机存取内存(DRAM)的设计。这些内存类型需要定期刷新,引入了延迟和数据位置的不确定性。

相反,Groq 使用静态随机存取存储器(SRAM),这种存储方式在双稳态锁存电路中稳定存储数据,避免了 DRAM 和 HBM 所依赖的晶体管/电容器结构,这一设计使得 Groq 能够准确知道任何特定时刻数据的位置,允许其编译器预先定义内存调用,通过相对简单的架构实现快速计算。

Groq 的技术在运行基于 Transformer 的模型(如 GPT-4)上表现出色,因为这类计算具有高度确定性。Groq 的系统特别适合序列操作,如基于 Token 的生成,每个新 Token 的生成依赖于前一个,这样的串行操作使得计算速度成为优势。

Groq 的创新不仅提高了计算效率,还可能改变与 AI 的互动方式。如其创始人所言,随着 AI 变得越来越类似于人类,与之交互的微小不便会变得更加明显和限制性。Groq 提供了一种通过高效、确定性的计算来保持交互幻觉的方法,这在实时交互和可能的实时视频生成方面开辟了新的可能性。

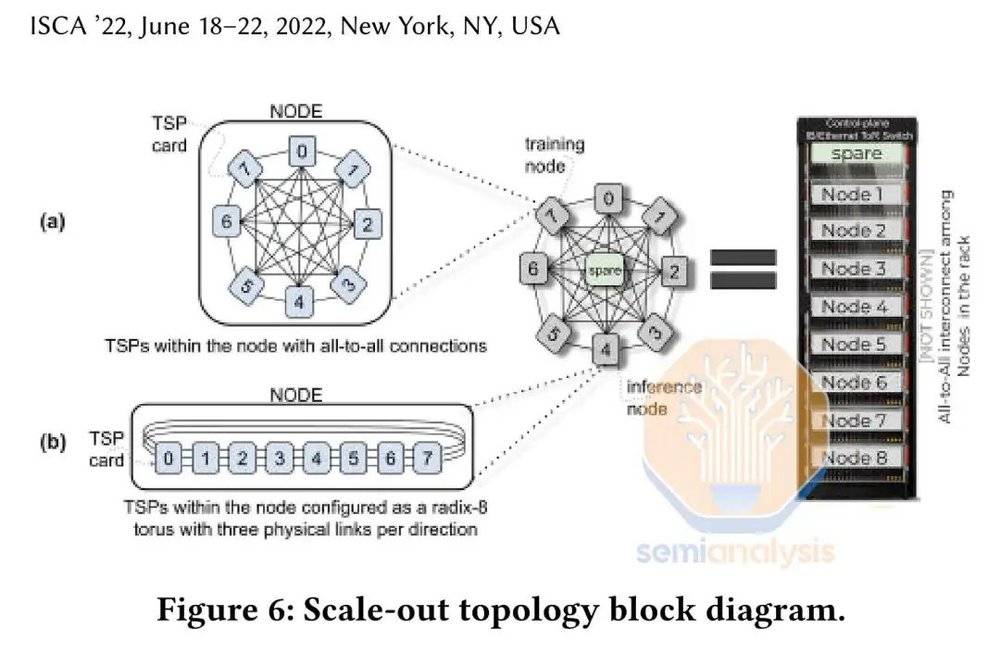

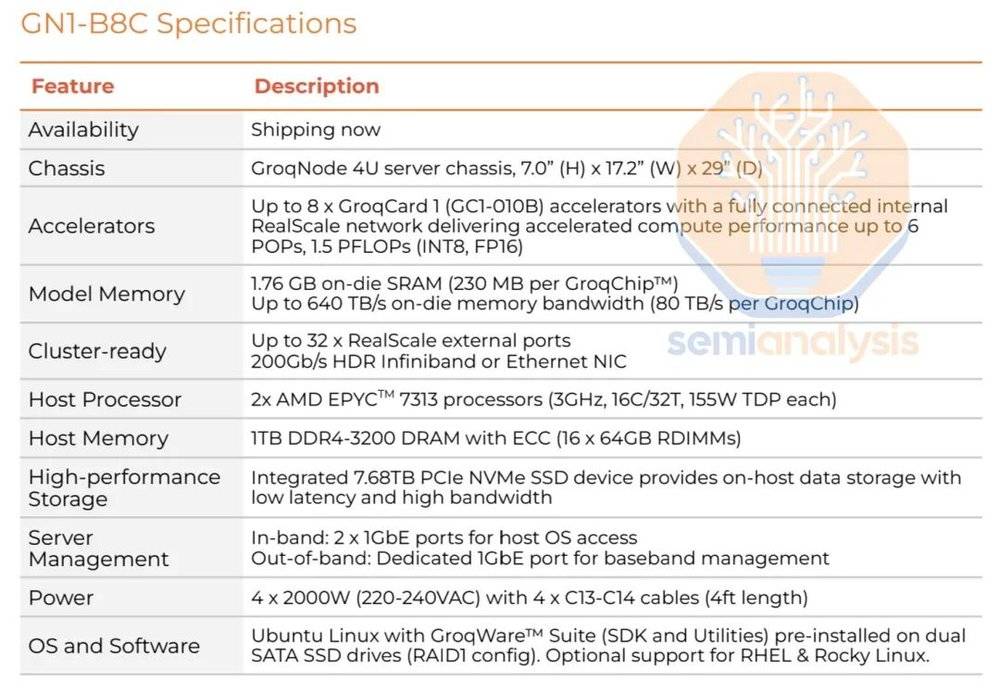

Groq 的芯片采用完全确定性的 VLIW(非常长指令字)架构,没有缓冲区,并且在 Global Foundries 的 14nm 工艺节点上达到了约 725mm^2 的芯片尺寸。它没有外部内存,并且在处理过程中将权重、KVCache 和激活等全部保留在芯片上。因为每个芯片只有 230 MB 的 SRAM,实际上没有有用的模型能够完全适应单个芯片。相反,它们必须使用许多芯片来适应模型,并将它们网络化连接起来。

图/semianalysis

Groq 在单个序列上拥有真正惊人的性能优势。这可能使得如思维链这样的技术在现实世界中更加可用。此外,随着 AI 系统变得自主,LLMs 的输出速度需要更高,以适应如代理程序之类的应用。

同样,代码生成也需要显著降低个 token 输出延迟。实时 Sora 风格模型可能是娱乐领域的一个惊人途径。如果延迟过高,这些服务甚至可能对最终市场客户来说既不可行也不可用。

这导致了关于 Groq 的硬件和推理服务将为 AI 行业带来革命性影响的巨大炒作。虽然对于某些市场和应用来说,它确实是一个游戏规则改变者,但速度只是方程的一部分。供应链多元化是另一个对 Groq 有利的因素,他们的芯片完全在美国制造和封装。

相比之下,Nvidia 、Google、AMD 和其他 AI 芯片需要从韩国进口内存,以及从台湾进口芯片/先进封装。

这些对 Groq 来说都是正面因素,但评估硬件是否具有革命性的主要公式是性能/总拥有成本。这是谷歌深刻理解的东西。

AI 时代的黎明已经到来,至关重要的是要理解,由AI驱动的软件的成本结构与传统软件大相径庭。芯片微架构和系统架构在开发和可扩展性这些创新新形式的软件中扮演着至关重要的角色。

AI 软件运行的硬件 Infra 对 Capex(资本性支出)和Opex(运营性支出)以及随后的毛利润有着明显更大的影响,与之前开发者成本相对较大的软件世代相比,这种影响更为显著。

因此,将相当大的注意力投入到优化你的 AI Infra 上,以能够部署 AI 软件,变得更加关键。在 Infra 上具有优势的公司,也将在部署和扩展 AI App 方面具有优势。

对于开发人员和 IT 团队来说,Groq 的 LPU 和软件架构带来了三个主要优势:

快速洞察:Groq 产品的高性能和低延迟可帮助数据科学家更快地构建和迭代机器学习模型。

更快的生产时间:Groq 的编译器和软件环境简化了部署,从而可以更快地进行实验。与生产模型交互的能力加快了开发周期。

面向未来的基础设施:Groq 的软件定义架构、先进网络和可扩展平台为 AI 增长提供了经济高效的基础。随着需求的变化,开发人员可以避免锁定或瓶颈。

创始人 Ross 还表示,Groq LPU 推理引擎已经证明,它比 GPU 更好、更快、更实惠,可用于通用 AI 语言推理。

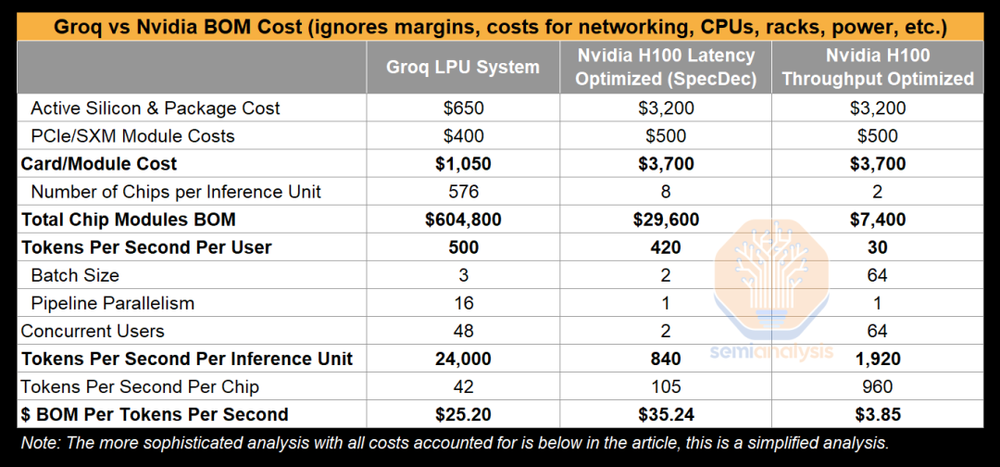

在 Mixtral 模型的情况下,Groq 不得不连接 8 个机架,每个机架有 9 台服务器,每台服务器有 8 个芯片。总共 576 个芯片组成了推理单元,用以服务 Mixtral 模型。相比之下,Nvidia 的单个 H100 就能在低批量大小下适配模型,并且两个芯片就有足够的内存支持大批量大小。

Groq 芯片的晶圆成本可能低于每晶圆 6000 美元。与此相比,Nvidia 的 H100 在 TSMC 的 5nm 定制变体 4N 上的芯片尺寸为 814mm^2,这些晶圆的成本接近每晶圆 16000 美元。另一方面,Groq 的架构对于实施产量收割似乎不那么可行,相比之下,Nvidia 由于在大多数 H100 SKU 中禁用了约 15% 的芯片面积,拥有极高的参数产量。

此外,Nvidia 为每颗 H100 芯片从 SK Hynix 购买 80 GB 的 HBM,成本约为 1150 美元。Nvidia 还必须支付 TSMC 的 CoWoS 成本并承担产量损失,而 Groq 没有任何芯片外内存。

Groq 的芯片原材料成本明显更低。Groq 还是一家初创公司,因此它们对芯片的低批量/相对固定成本较高,这包括必须支付 Marvell 一大笔定制 ASIC 服务的利润。

图/semianalysis

这张表格展示了三种部署,表格中展示了 Groq 输出每个 token 的硅材料成本方面相对于 Nvidia 系统有一个芯片架构上的优势。

8xA100 可以服务 Mixtral 并实现每用户约 220 个 token 每秒的吞吐量,而 8xH100 可以在没有推测性解码的情况下达到每用户约 280个 token 每秒。

通过推测性解码,8xH100 推理单元可以实现接近每用户 420 个 token 每秒的吞吐量。虽然吞吐量可能超过这个数字,但在 MoE(专家混合)模型上实施推测性解码是具有挑战性的。

由于经济性非常差,目前还不存在以延迟优化的 API 服务。API 提供商目前看不到为更低的延迟收取 10 倍以上费用的市场。一旦代理和其他极低延迟任务变得更受欢迎,基于 GPU 的 API 提供商可能会启动延迟优化的 API ,与他们当前的吞吐量优化的 API 并行。

一旦 Groq 下周实施他们的批处理系统,即使是采用推测性解码的延迟优化 Nvidia 系统在吞吐量和成本上也远远落后于没有推测性解码的 Groq 。

此外,Groq 使用的是较旧的 14nm 工艺技术,并向 Marvell 支付了可观的芯片利润。如果 Groq 获得更多资金并且能够提升他们下一代 4nm 芯片的生产,预计在 2025 年下半年推出,经济情况可能开始发生显著变化。值得注意的是,Nvidia 远非坐以待毙,我们认为他们将在不到一个月的时间内宣布他们的下一代 B100。

在吞吐量优化系统中,经济情况显著改变。Nvidia 系统在BOM基础上每美元性能获得一个数量级的提升,但每用户吞吐量较低。对于吞吐量优化场景,Groq 在架构上完全不具备竞争力。

此外,创始人 Ross 还强调了 Groq 在美国制造的承诺,并指出 Groq 的芯片由 Global Foundries 在美国制造。在加拿大封装,并在加利福尼亚州组装,在地缘政治压力下的技术供应链中,拥有国内产能具有战略优势。对于国防和受监管行业,本地制造还可以简化合规性。

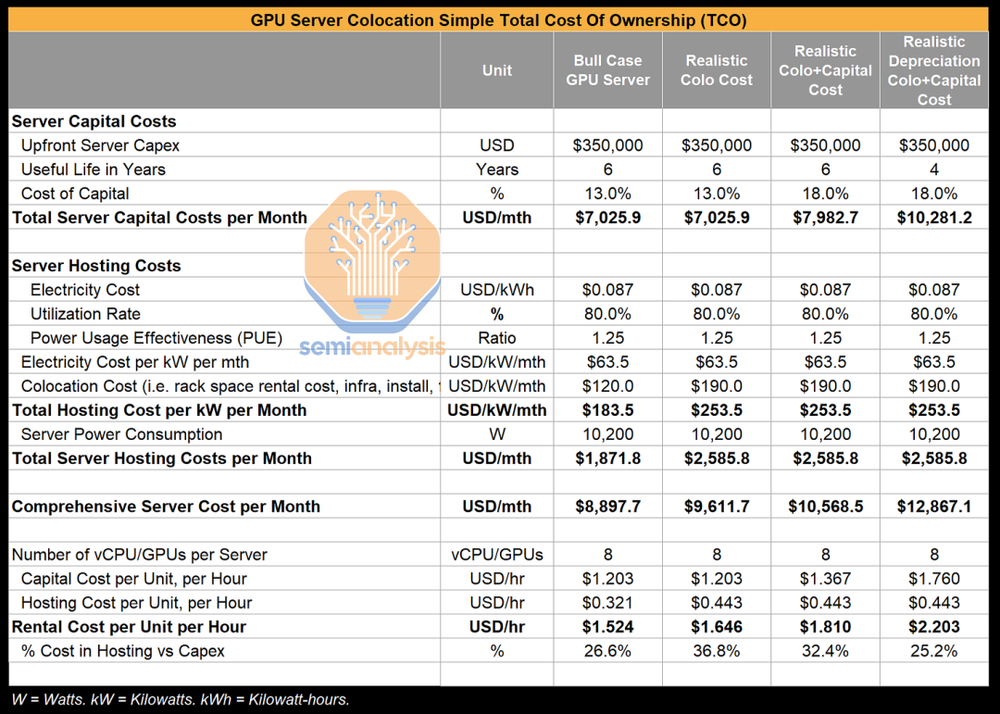

“Tokenomics”(代币经济学)看起来非常不同。Nvidia 的 GPU 基板拥有巨大的毛利润。此外,对服务器收取的 350000 美元价格,远高于超大规模计算提供商的 H100 服务器成本,还包括了显著的内存成本、8 个 InfiniBand NICs 的总带宽为 3.2 Tbps 以及在 Nvidia 利润之上叠加不错的 OEM 利润。

图/semianalysis

Groq正在估算系统成本,并考虑到芯片、封装、网络、CPU、内存的细节,同时假设较低的整体 ODM 利润。没有包括 Groq 销售硬件所收取的利润,但这也是 Groq 的成本与推理 API 提供商的成本的公平比较,因为两者都在提供相同的产品/模型。

图/semianalysis

值得注意的是,8 个 Nvidia GPU 只需要 2 个 CPU,但 Groq 的 576 芯片系统目前有 144 个 CPU 和 144 TB 的 RAM。

参考资料:

https://groq.com/

https://wow.groq.com/news_press/groq-lpu-inference-engine-leads-in-first-independent-llm-benchmark/

https://dzone.com/articles/ai-real-how-groq-simplifies-machine-learning

On the business, strategy, and impact of technology. Sora, Groq, and Virtual Reality,Stratechery;

Groq Inference Tokenomics,Semianalysis;

本文来自微信公众号:有新Newin(ID:NewinData),作者:有新